Le Model Context Protocol (MCP) ouvre la voie à une nouvelle façon de faire dialoguer les modèles d’IA et leurs outils. Que ce soit pour tester un environnement local ou déployer une architecture prête à l’emploi dans Azure, MCP apporte une approche standardisée, simple à expérimenter mais suffisamment flexible pour être adaptée à des besoins complexes.

Dans cet article, je vous propose un tutoriel pas à pas pour mettre en place un serveur MCP, le tester avec MCP Inspector, puis le déployer dans Azure afin d’explorer tout son potentiel.

Qu’est-ce que MCP ?

Mon premier article est un bon point de départ pour vous informer sur le sujet :

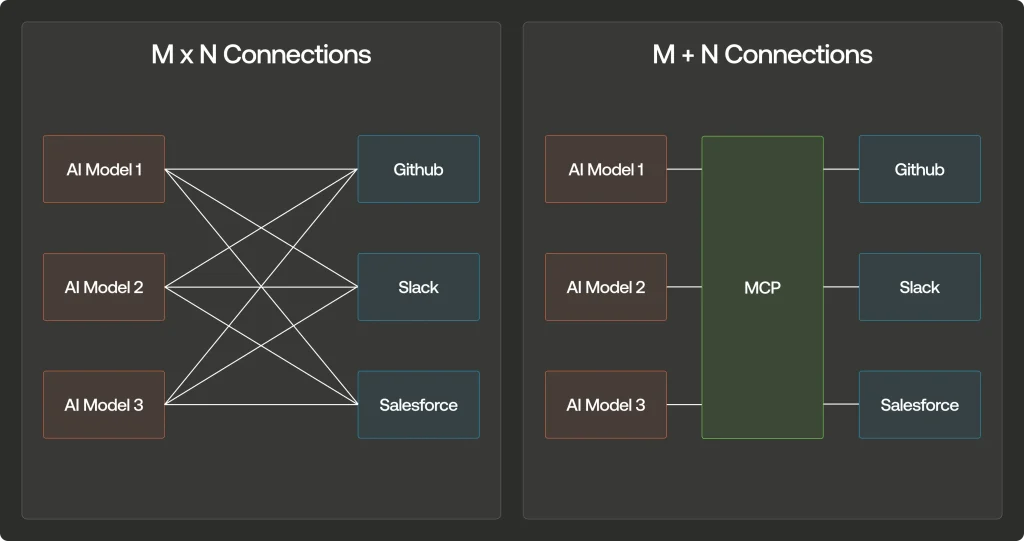

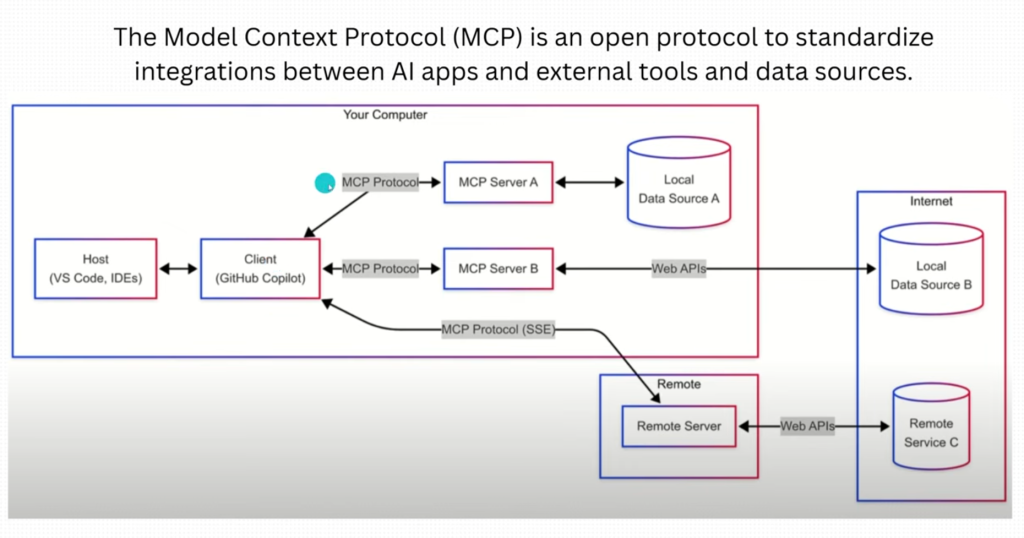

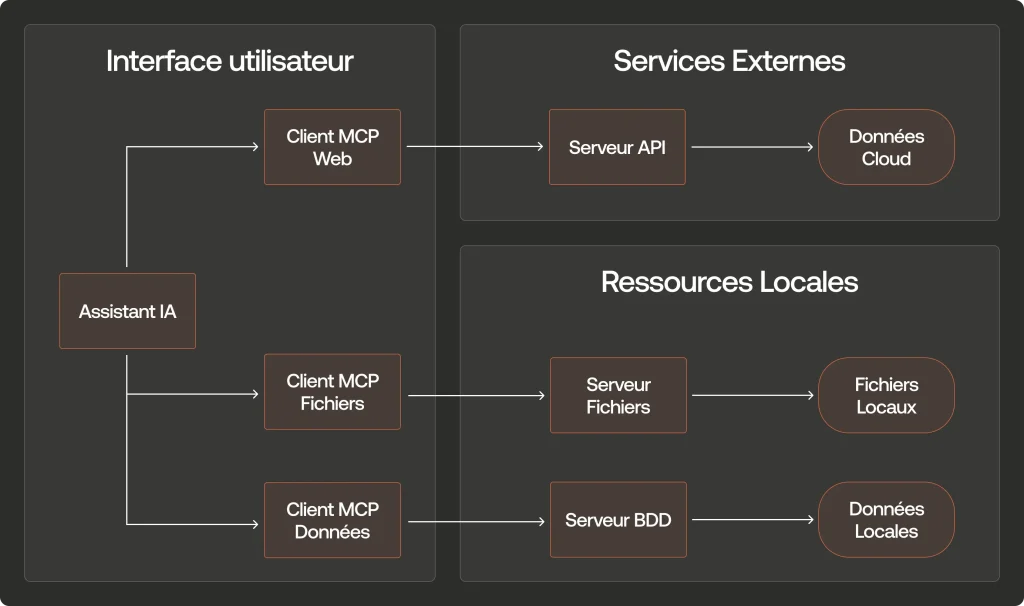

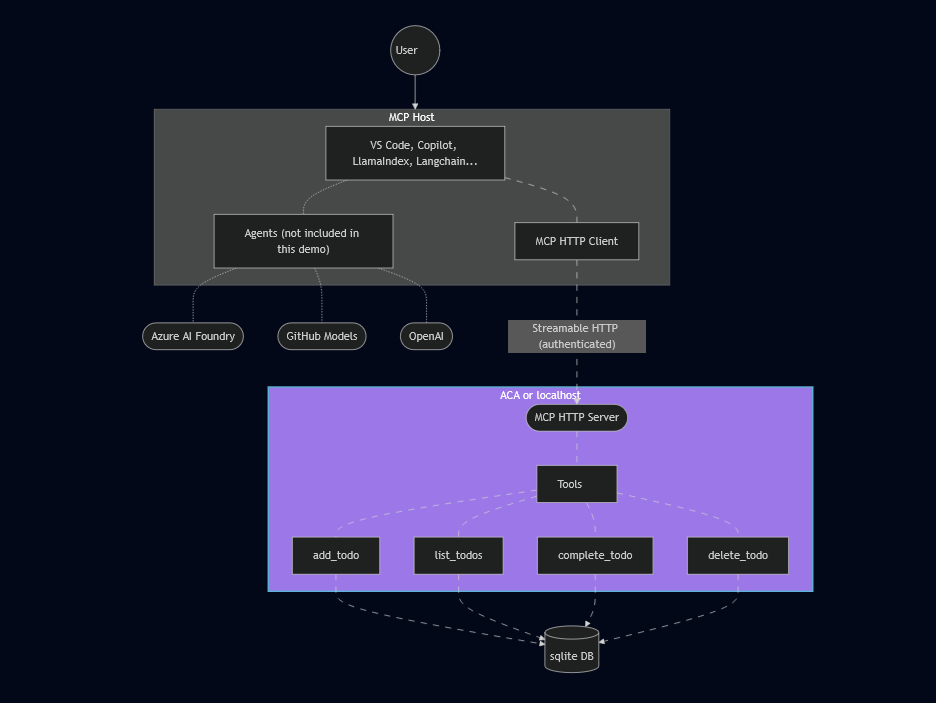

Le protocole MCP (Model Context Protocol) est un protocole qui permet à différents modèles et outils d’IA de communiquer entre eux. Il fournit un moyen standardisé pour les modèles de partager des informations et de collaborer sur des tâches. Le serveur MCP sert de pont entre différents modèles et outils, leur permettant de fonctionner ensemble de manière transparente.

Je peux également vous conseiller de voir cette vidéo, mais également de consulter la page officielle du protocole MCP :

Vous trouverez ci-dessous le schéma d’architecture d’une configuration type de serveur MCP :

Enfin cette page rassemble une collection d’implémentations de serveurs MCP, qu’il s’agisse de versions officielles (références) ou proposées par la communauté. Elle sert de bibliothèque centrale pour explorer et découvrir des exemples de serveurs MCP capables de fournir aux modèles d’IA un accès contrôlé à des outils ou sources de données.

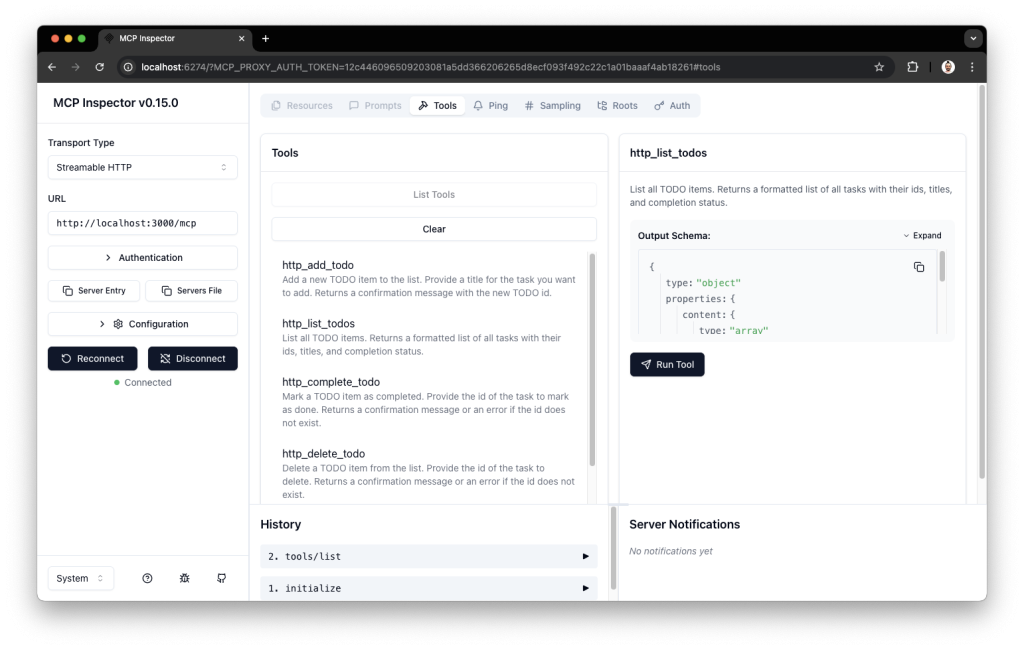

Qu’est-ce que MCP Inspector ?

MCP Inspector est un outil graphique fourni par l’équipe du Model Context Protocol qui sert à tester, déboguer et explorer un serveur MCP.

Il permet notamment de :

- Se connecter à un serveur MCP local ou distant

- Lister les outils (tools) que le serveur met à disposition.

- Tester ces outils en leur envoyant des requêtes et en visualisant les réponses.

- Explorer d’autres ressources exposées par le serveur, comme les prompts ou les files.

- Vérifier en temps réel le statut de connexion et les échanges de données.

En résumé, c’est l’équivalent d’une console d’administration interactive qui te permet de voir comment ton serveur MCP réagit et d’expérimenter ses fonctionnalités sans devoir écrire du code côté client.

Envie de tester le déploiement d’un serveur MCP sur Azure ?

Cette page explique comment tester un serveur MCP en local ou hébergé sur Azure à l’aide de clients MCP sur desktop, comme Visual Studio Code ou MCP Inspector :

Ce guide constitue donc un point de départ idéal pour expérimenter la connexion et l’interaction avec un serveur MCP.

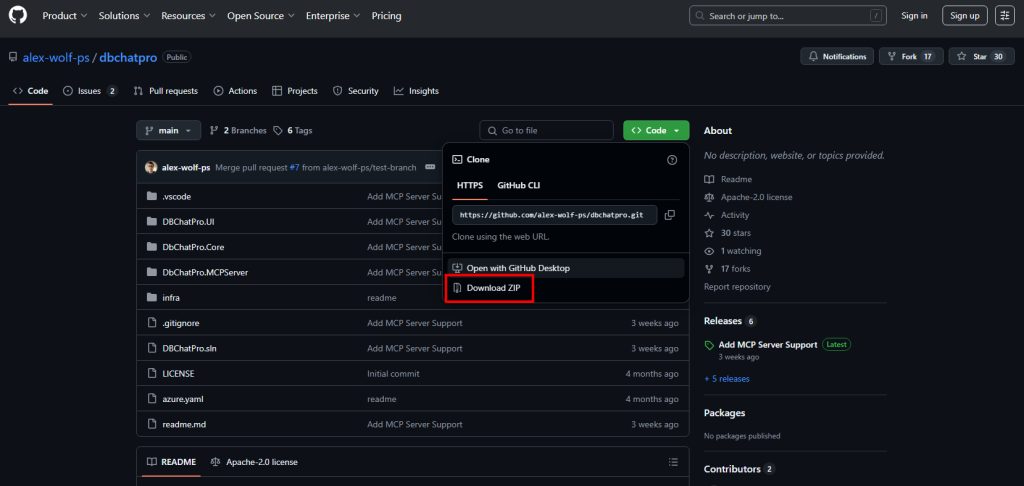

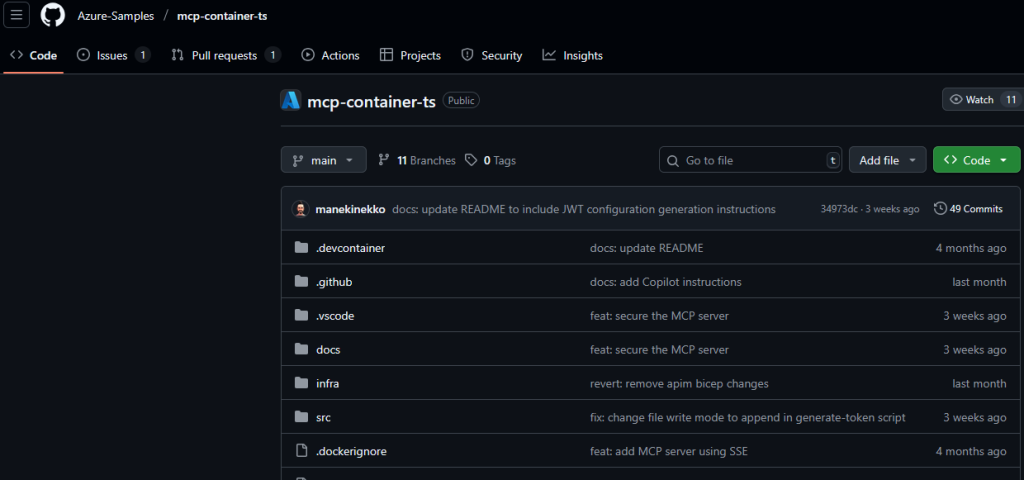

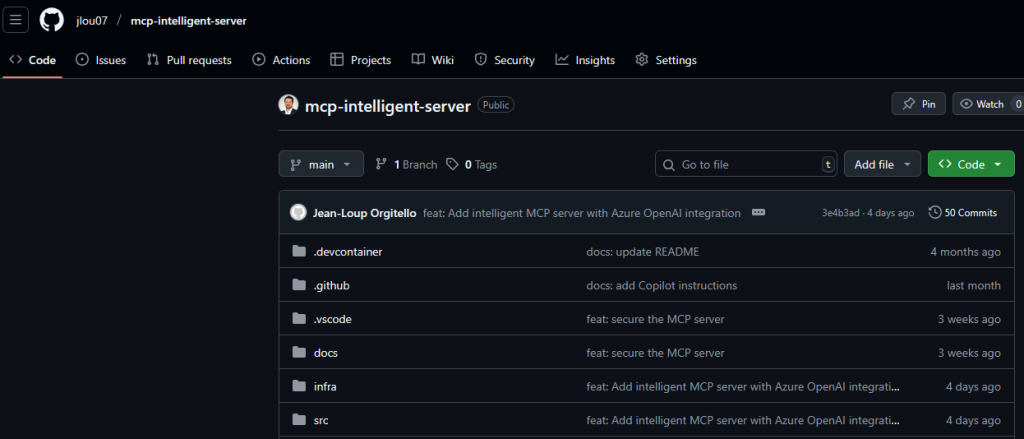

Afin de rendre la démonstration plus complète, j’y ai effectué quelques modifications, et j’ai publié le tout sur mon GitHub :

L’exercice consiste à configurer un serveur MCP, d’abord en local puis sur Azure, afin de comprendre son fonctionnement et tester ses outils :

- Vous expérimentez ensuite les actions soit directement via ces outils, soit au travers de prompts, en observant le code généré à chaque étape.

- La seconde partie de l’exercice consiste à déployer sur Azure Container Apps pour valider le bon fonctionnement du serveur MCP hébergé.

Maintenant, il ne nous reste plus qu’à tester tout cela 😎

- Etape 0 – Rappel des prérequis

- Etape I – Déploiement du serveur MCP en local

- Etape II – Tests du serveur MCP local

- Etape III – Déploiement du serveur MCP sur Azure

Etape 0 – Rappel des prérequis :

Pour réaliser cet exercice, il vous faudra disposer de :

- Un abonnement Azure valide

- Un tenant Microsoft

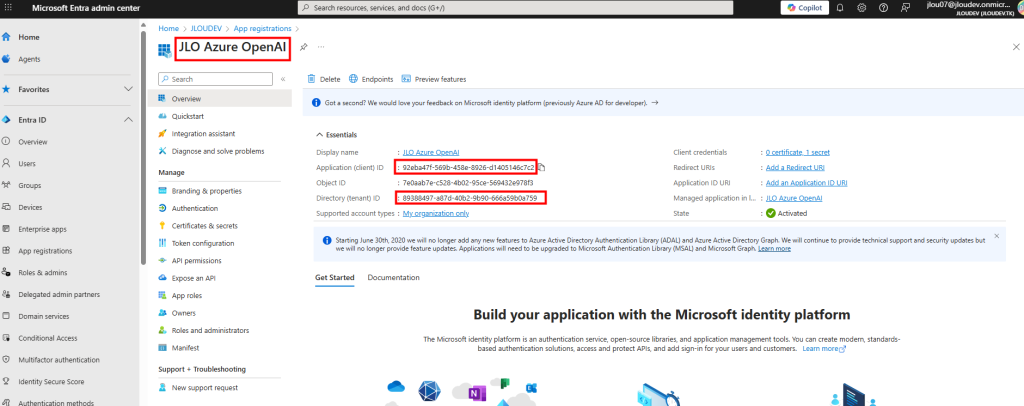

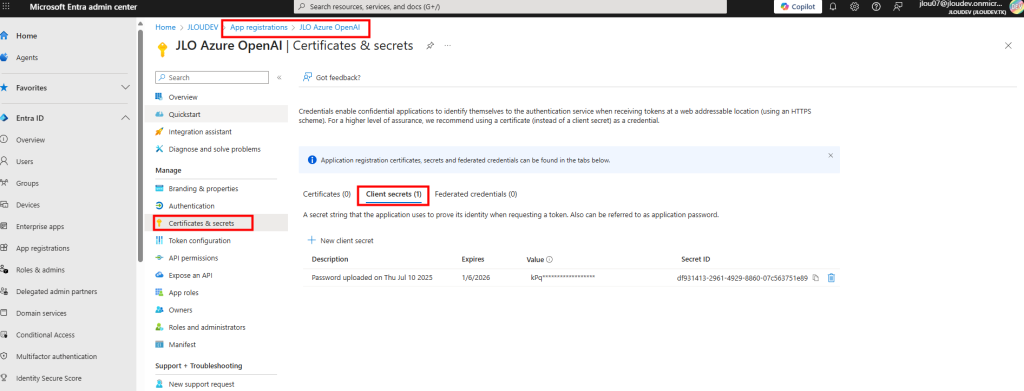

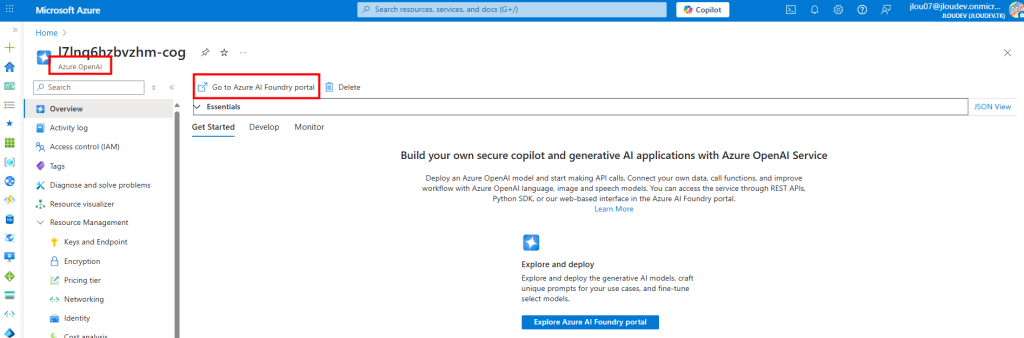

- Un modèle c’IA déployé sur Azure OpenAI

Commençons par tester la solution en local.

Etape I – Déploiement du serveur MCP en local :

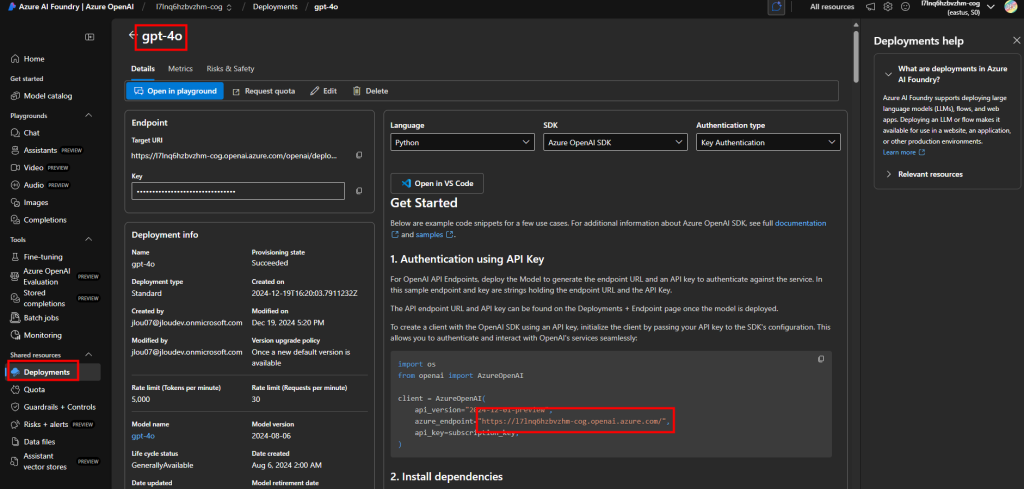

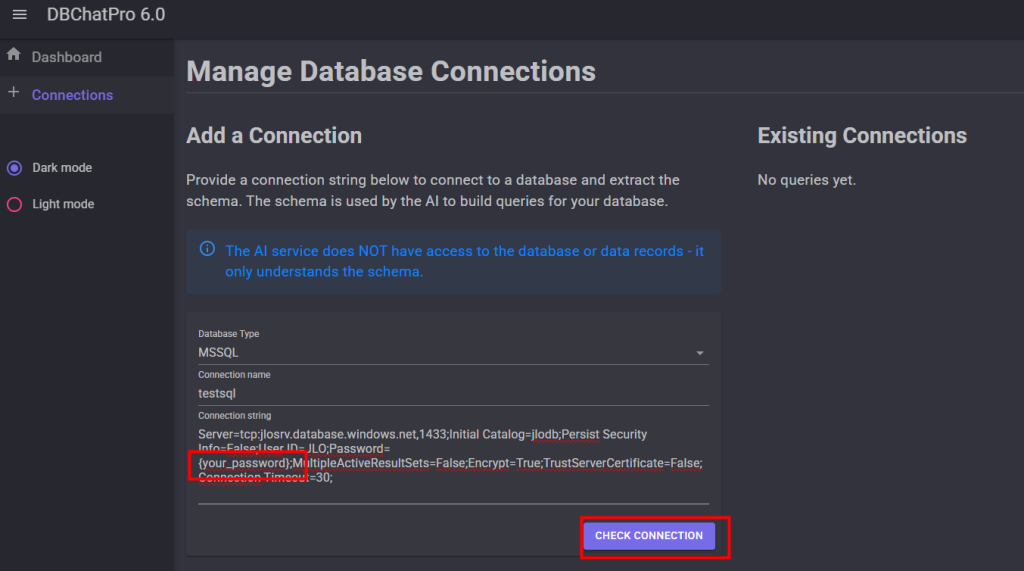

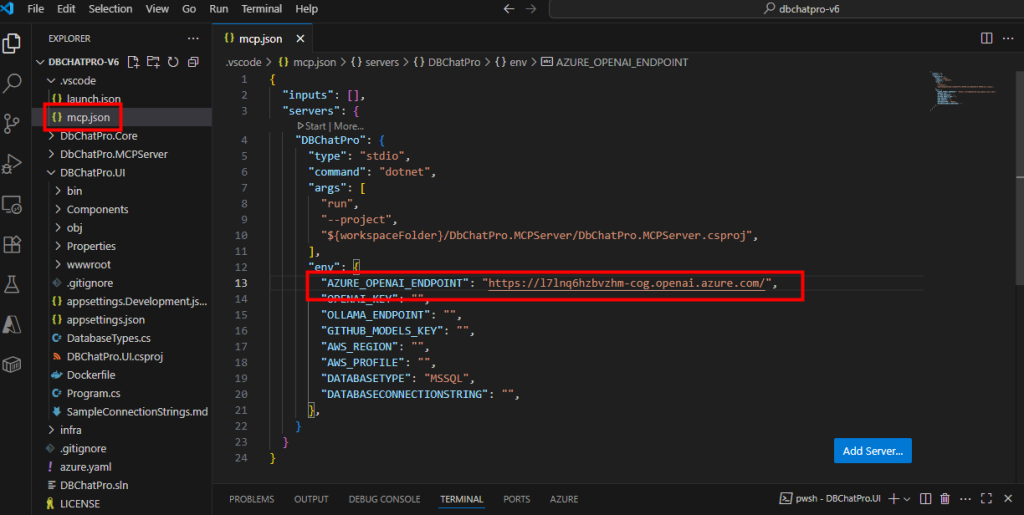

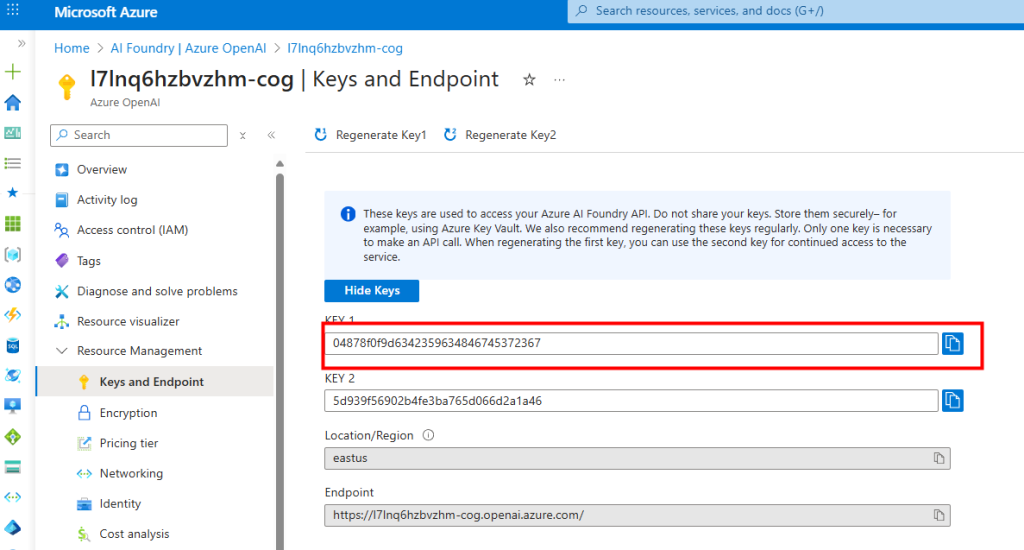

Avant cela, rendez-vous sur la page Azure OpenAI, puis copiez une des clés d’API :

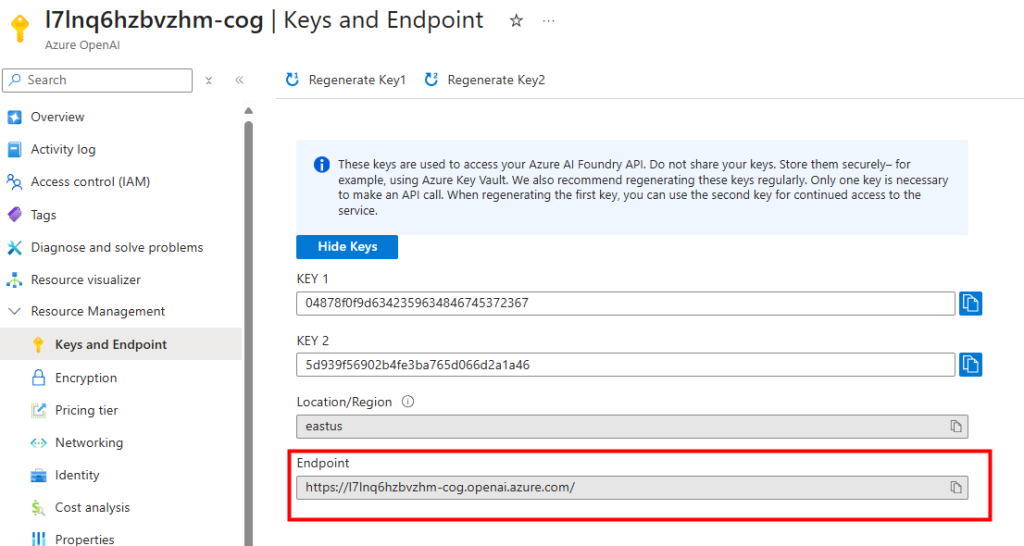

Copiez également le point de terminaison depuis cette même page :

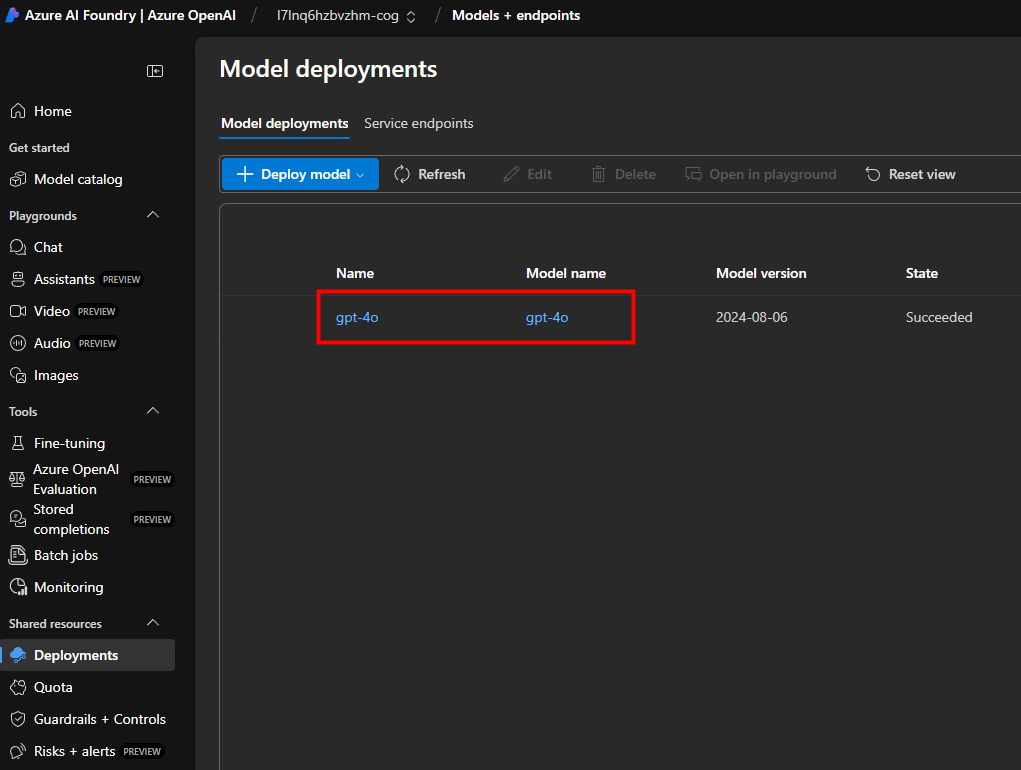

Accédez au portail Azure AI Foundry, créez un modèle, puis copiez son nom :

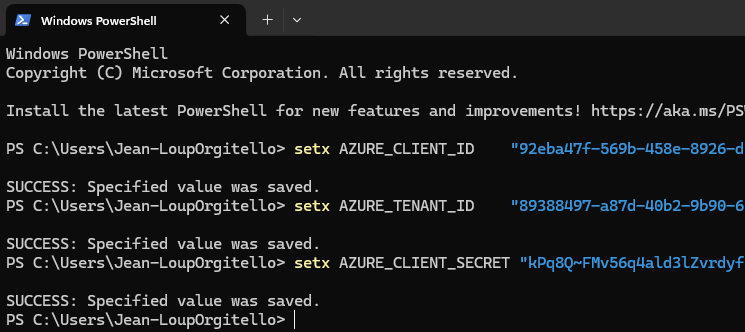

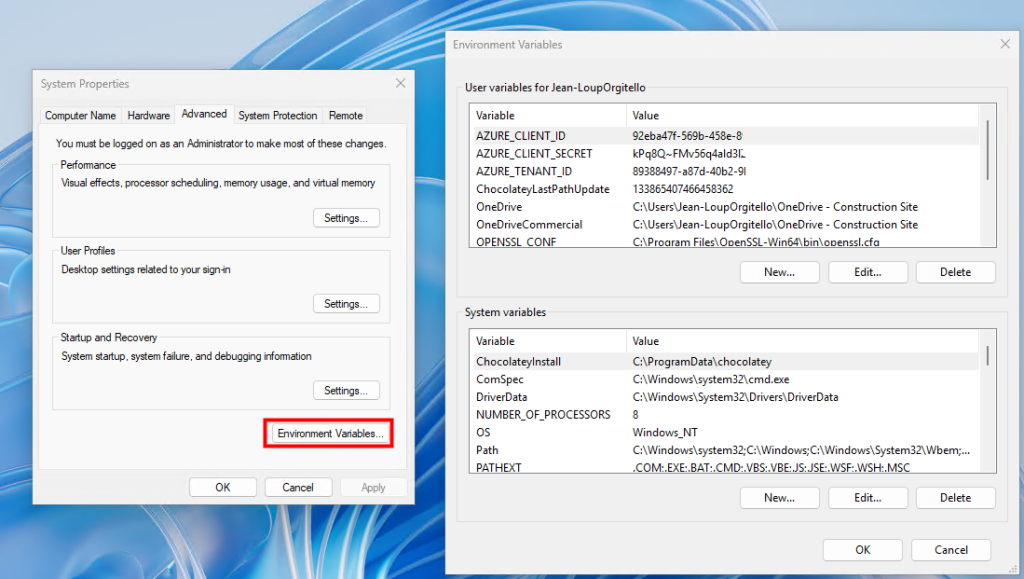

Sur votre poste, ouvrez une fenêtre Terminal :

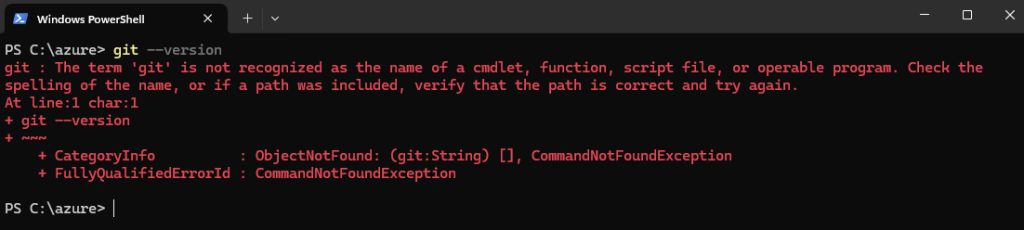

Lancez la commande suivante pour vérifier si Git est installé :

git --version

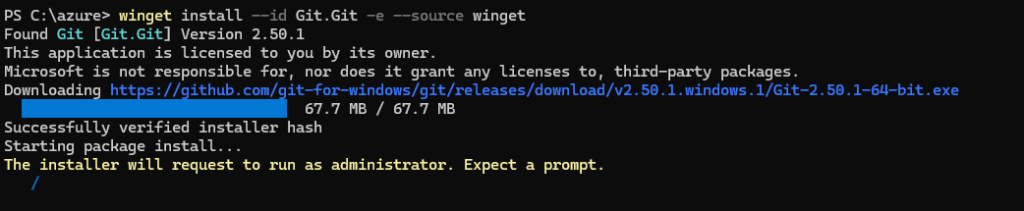

Si Git n’est pas encore installé, exécutez la commande suivante pour le faire :

winget install --id Git.Git -e --source winget

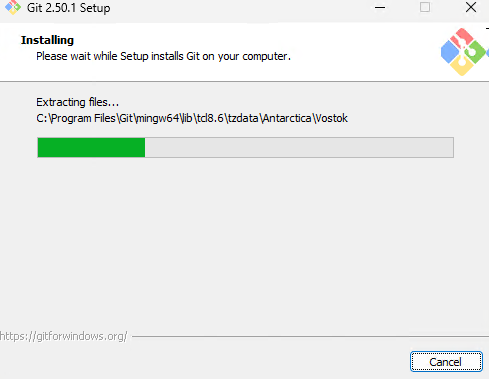

Attendez la fin de l’installation de Git :

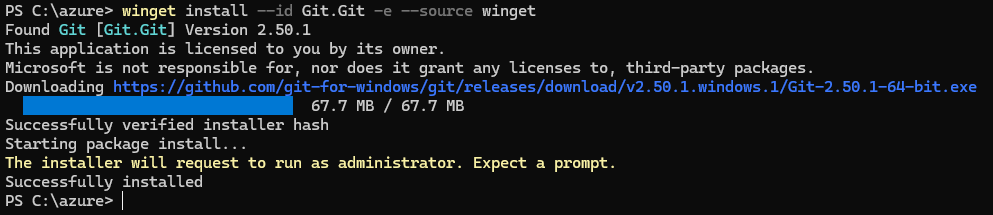

Vérifiez que l’installation de Git s’est bien effectuée :

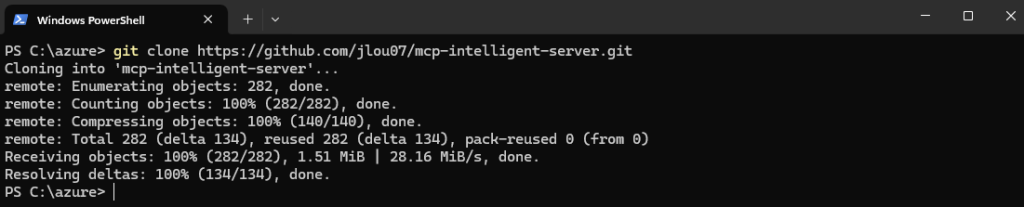

Lancez la commande suivante pour récupérer le package au format Git depuis mon dépôt GitHub :

git clone https://github.com/jlou07/mcp-intelligent-server.git

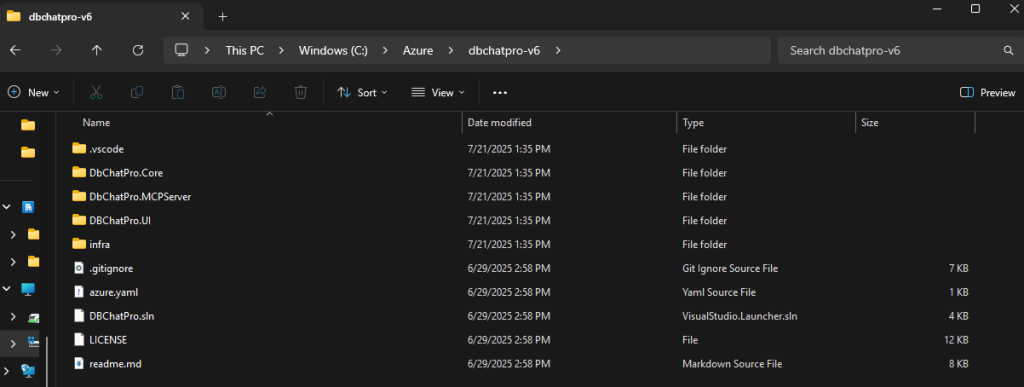

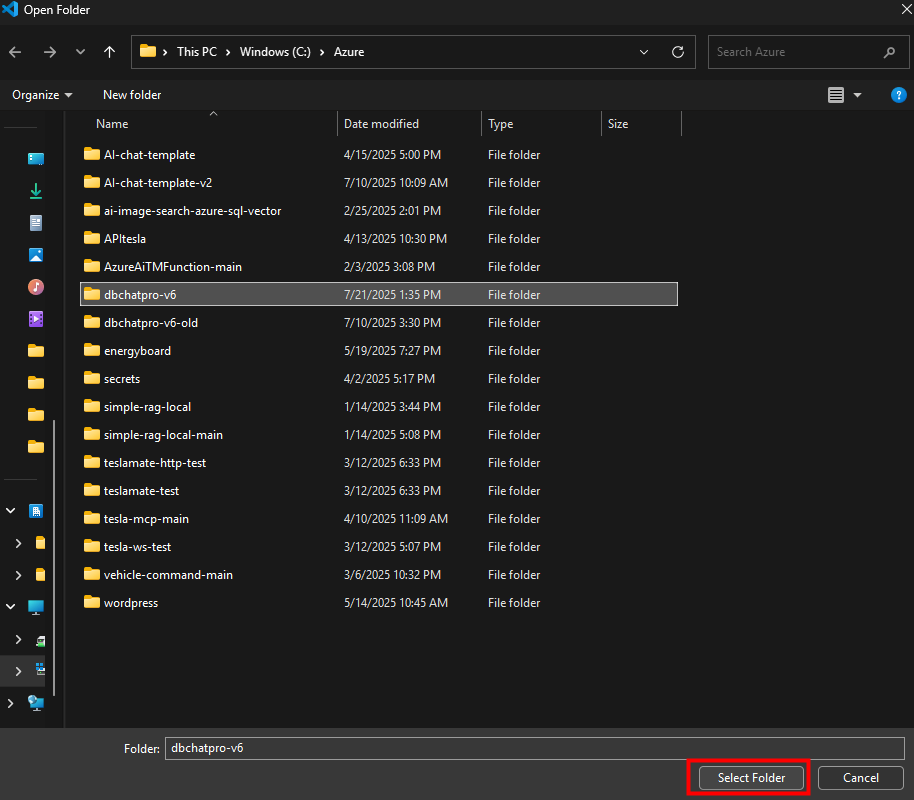

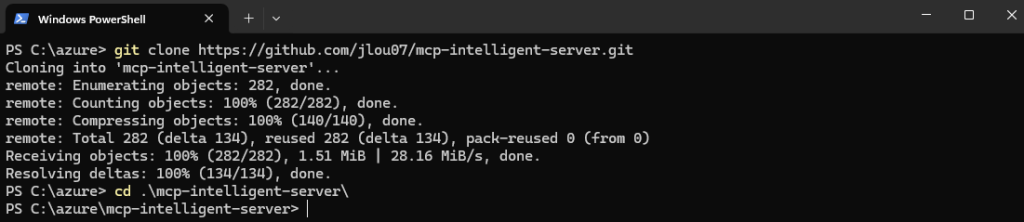

Accédez au dossier du package téléchargé :

cd .\mcp-intelligent-server\

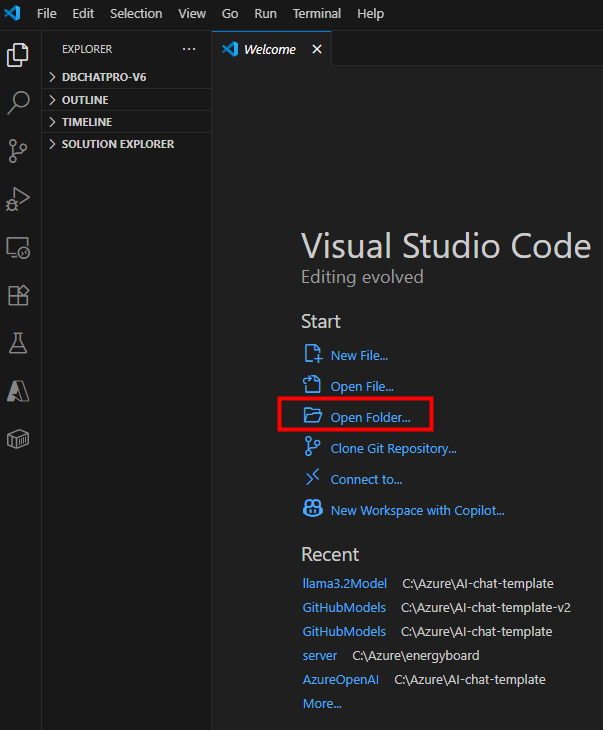

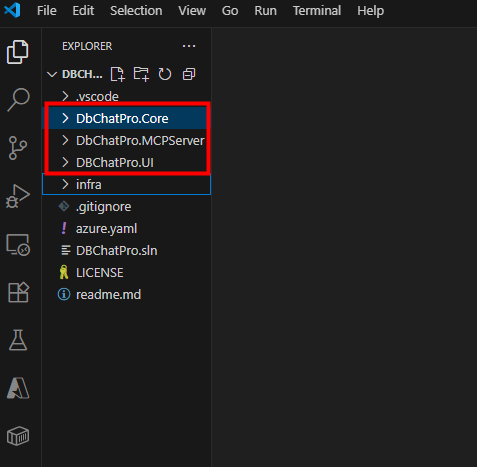

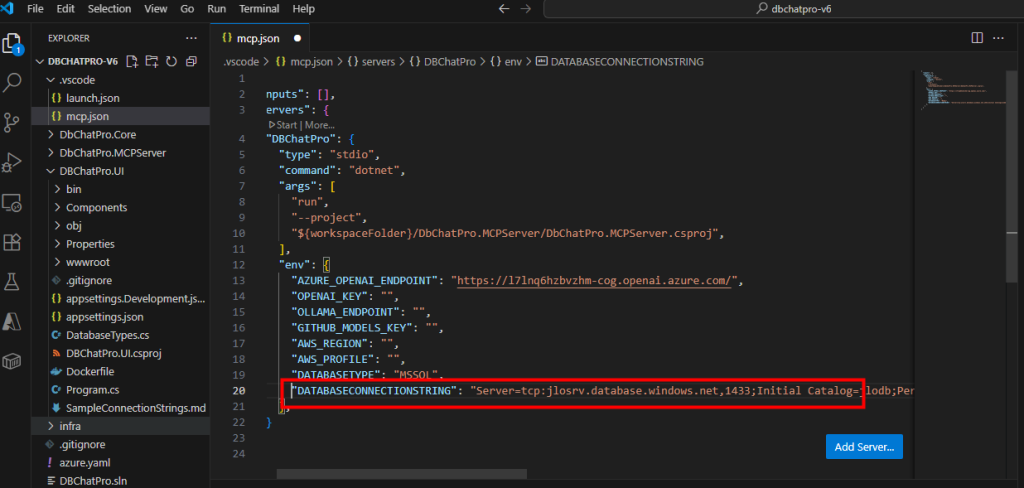

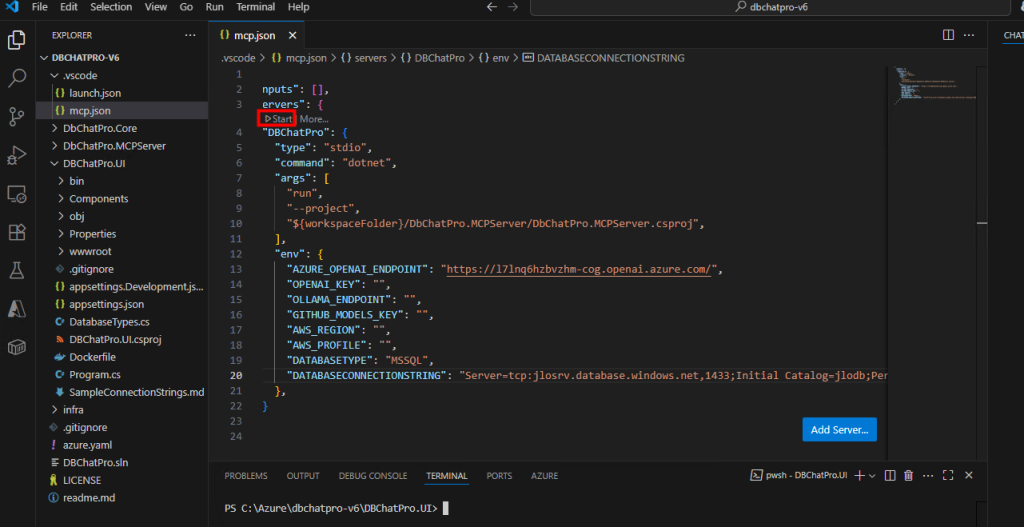

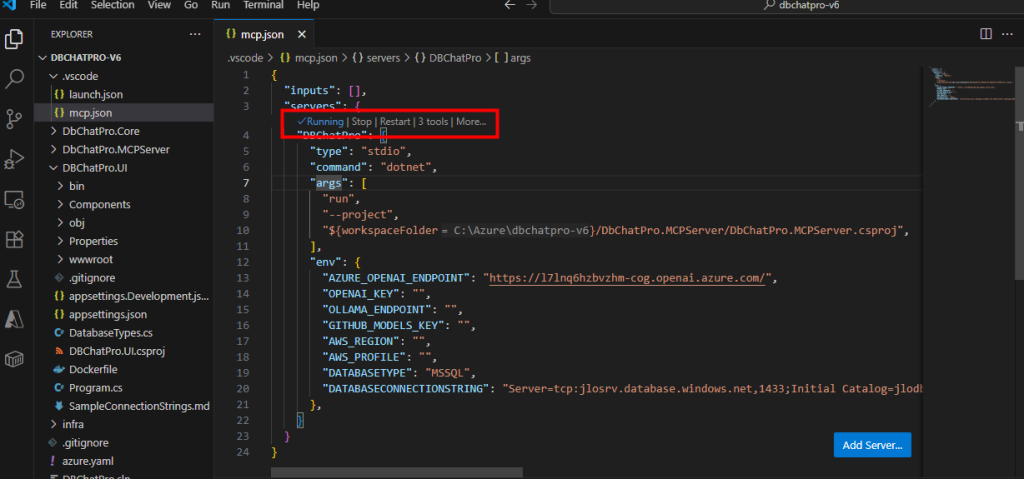

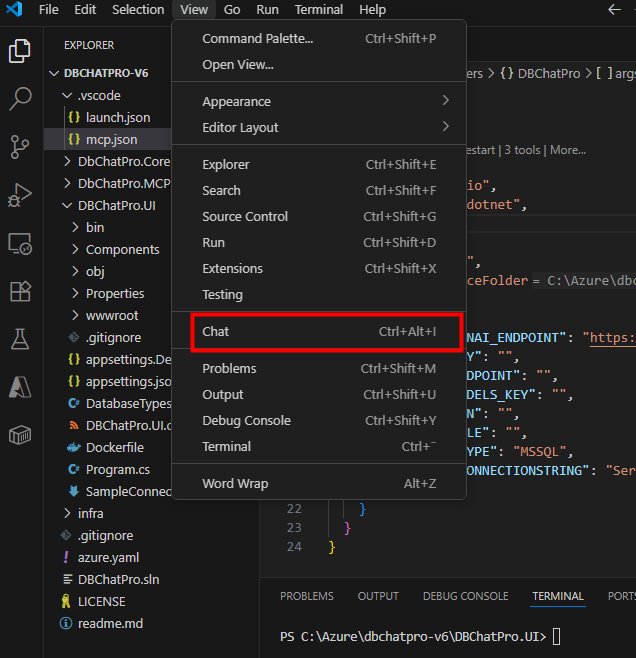

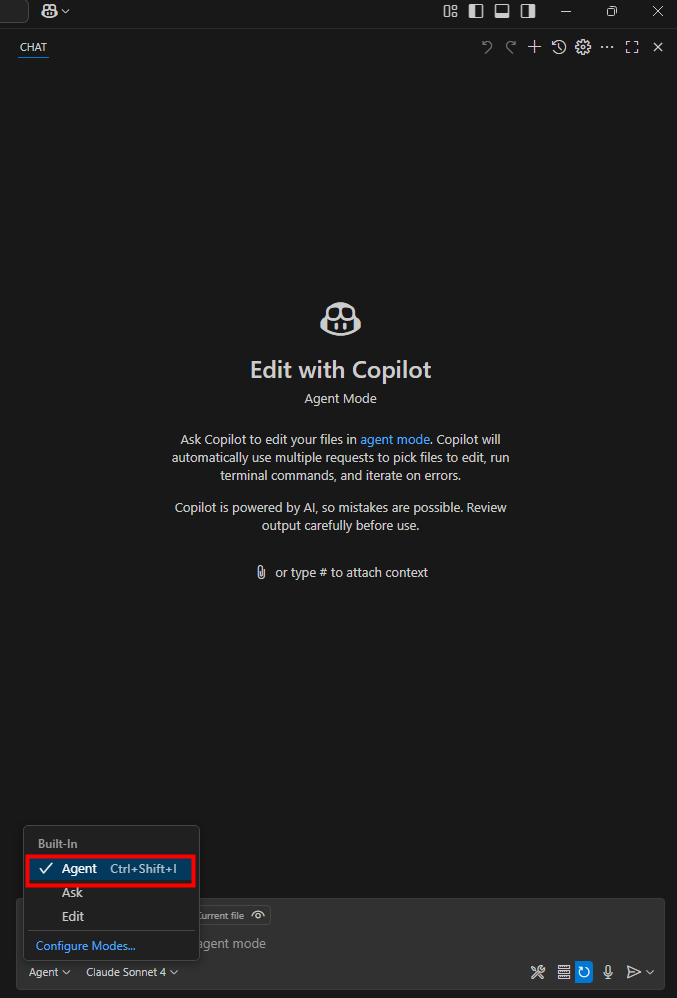

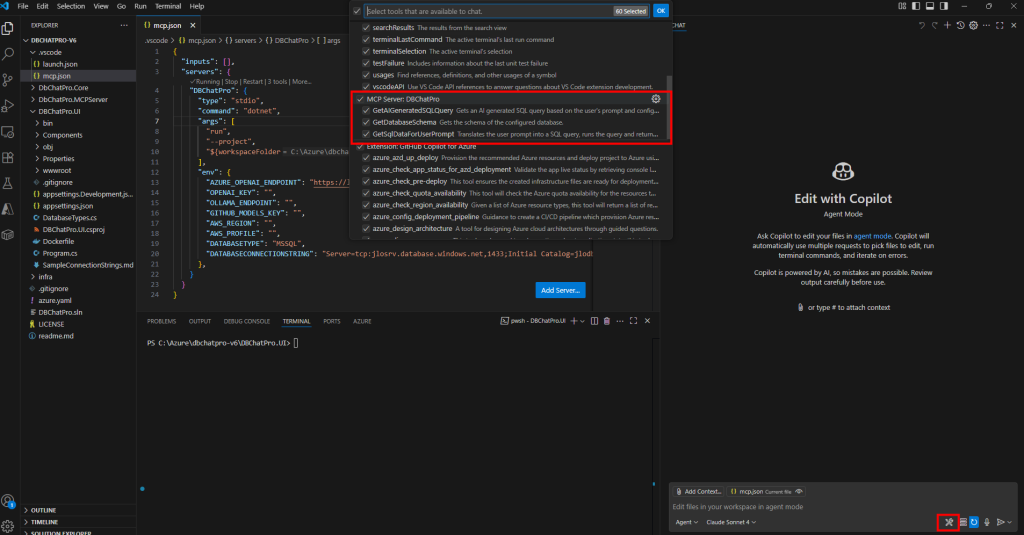

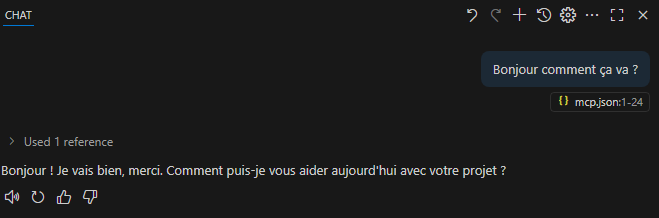

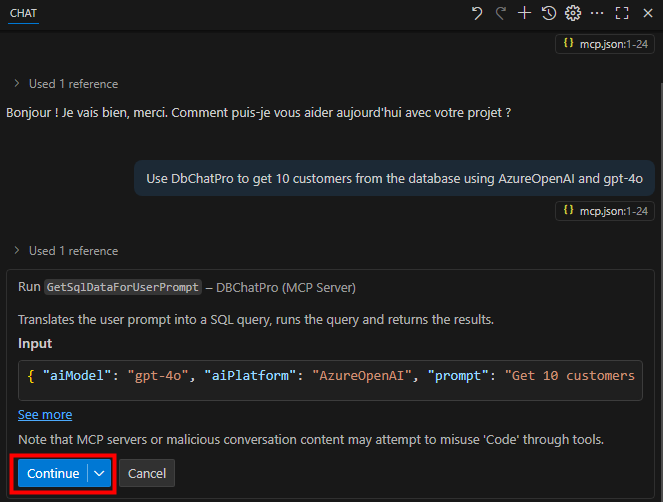

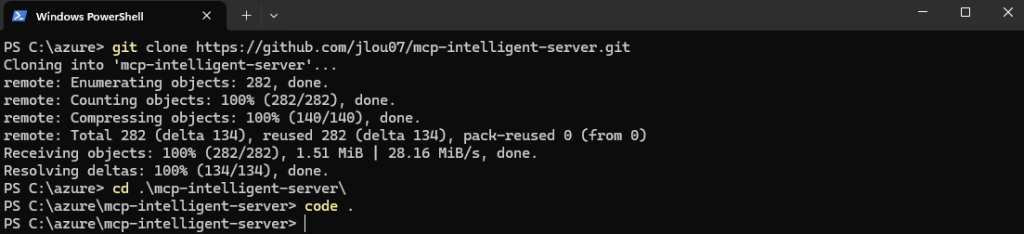

Ouvrez Visual Studio Code avec la commande suivante :

Code .

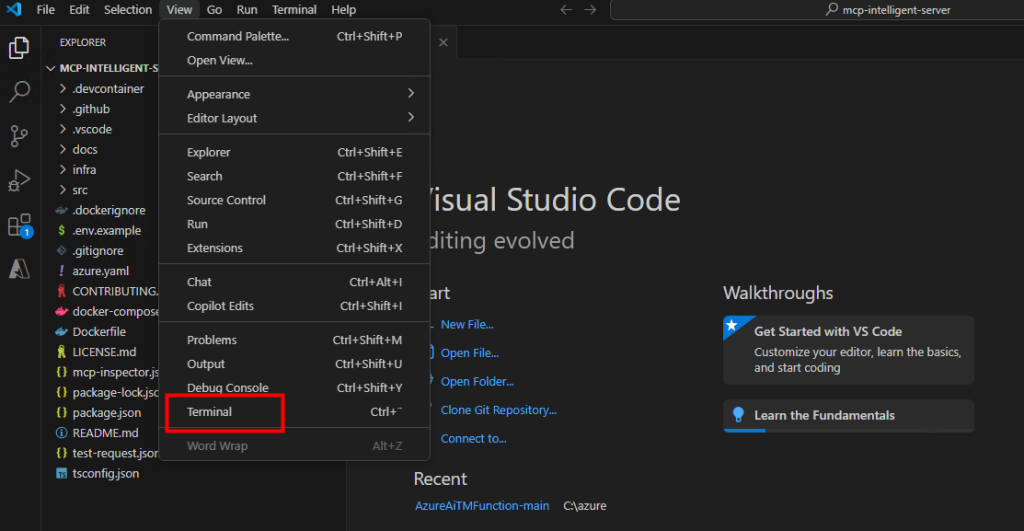

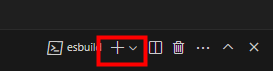

Dans Visual Studio Code, ouvrez le terminal intégré :

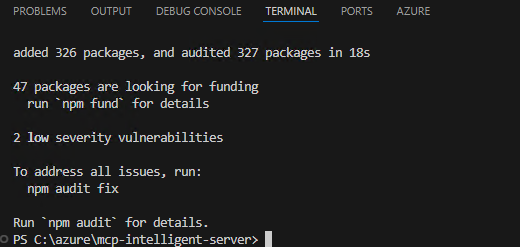

Exécutez la commande suivante pour installer NPM (gestionnaire de paquets Node.js) :

npm installAttendez la fin de l’installation des différents packages NPM :

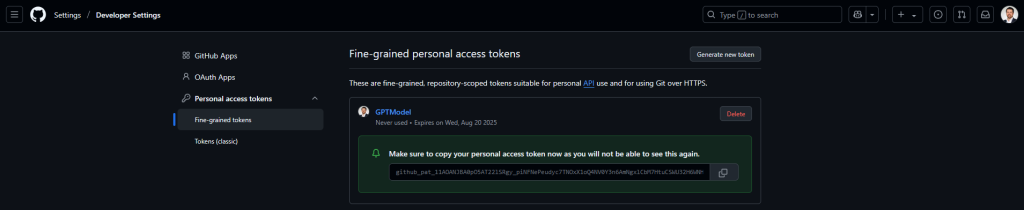

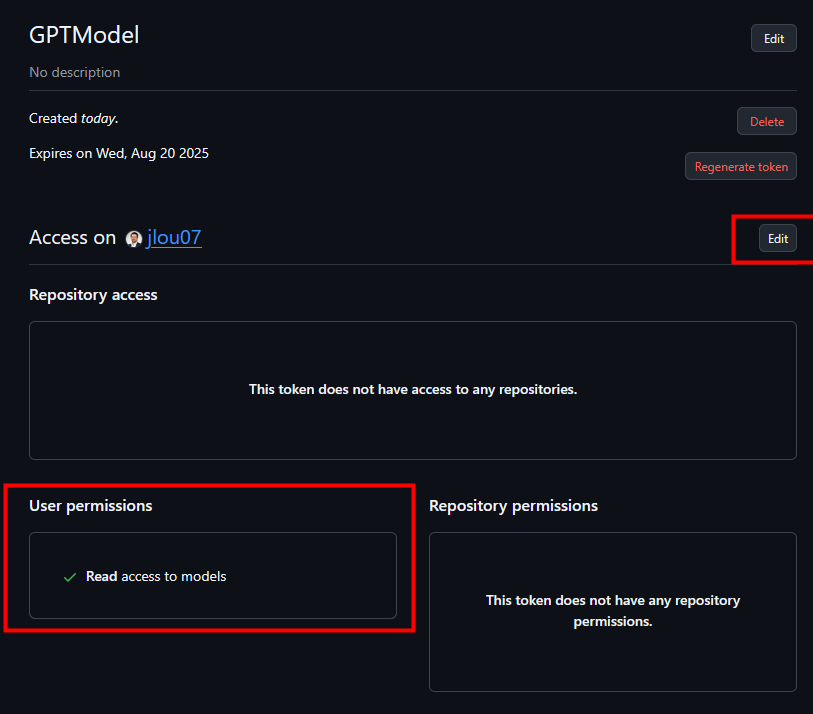

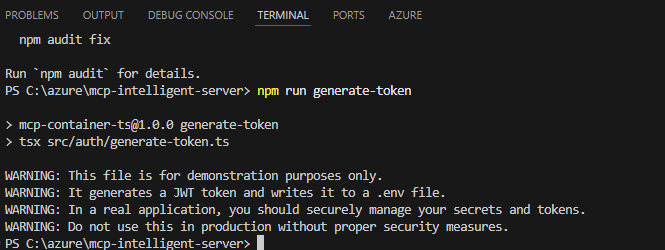

Lancez le script suivant pour générer un token sur le serveur MCP :

npm run generate-token

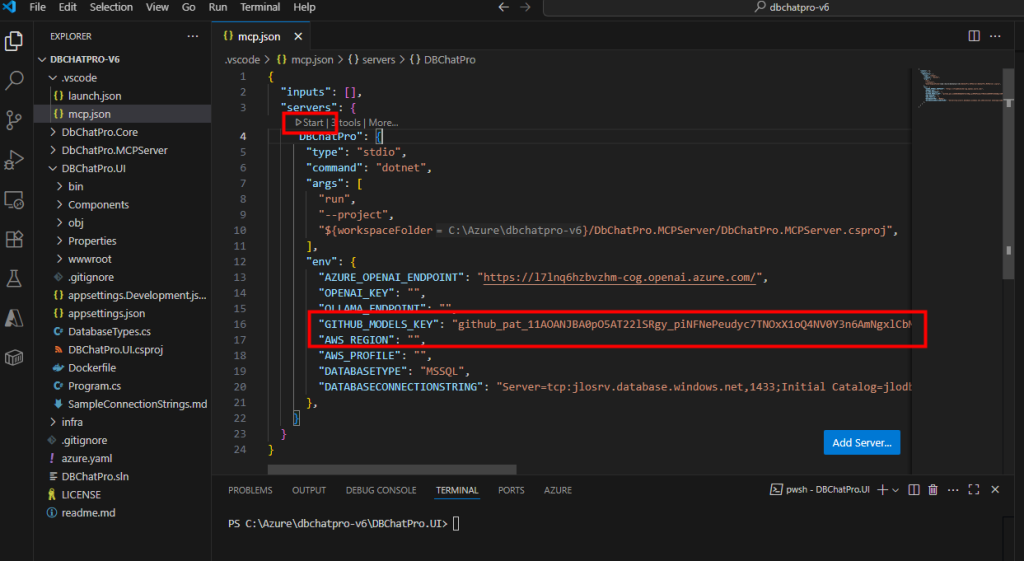

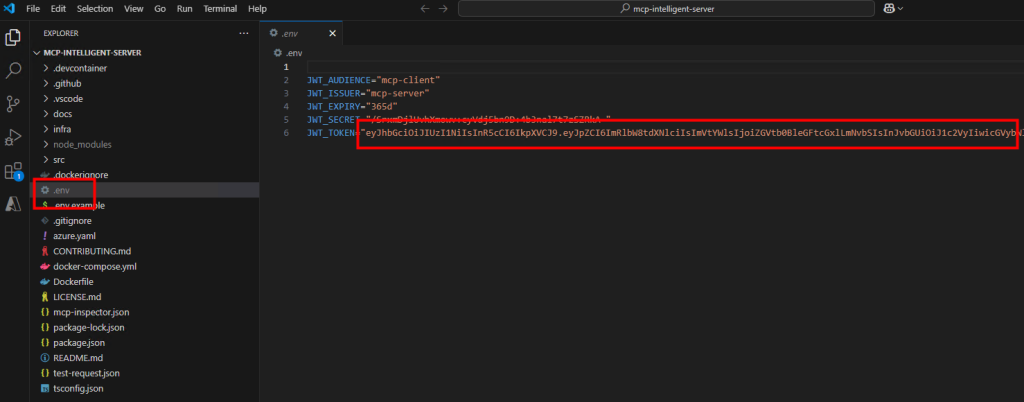

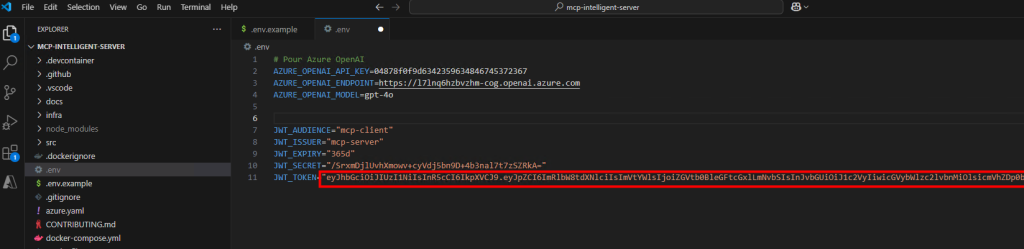

Vérifiez la création du fichier .env et copiez la valeur du token généré :

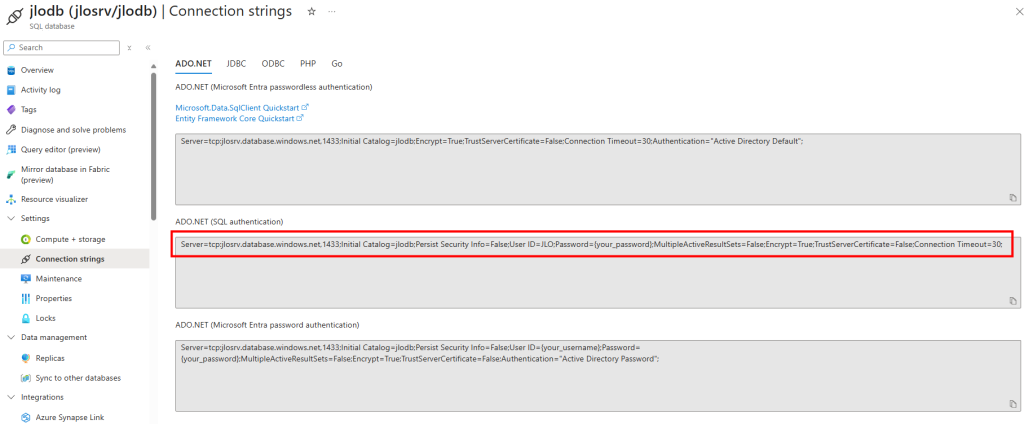

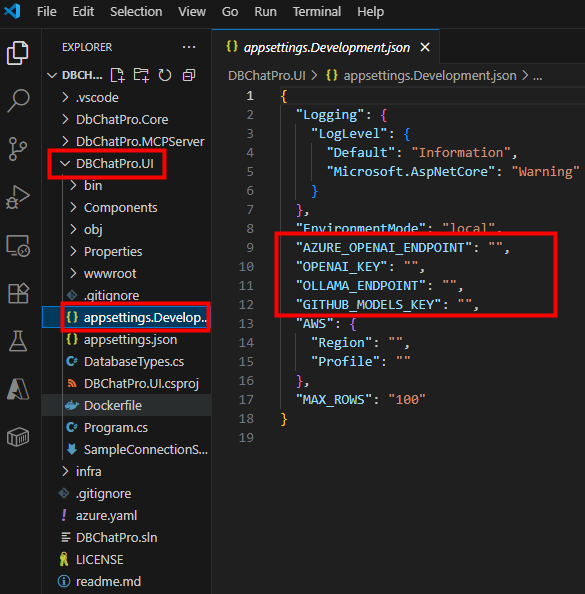

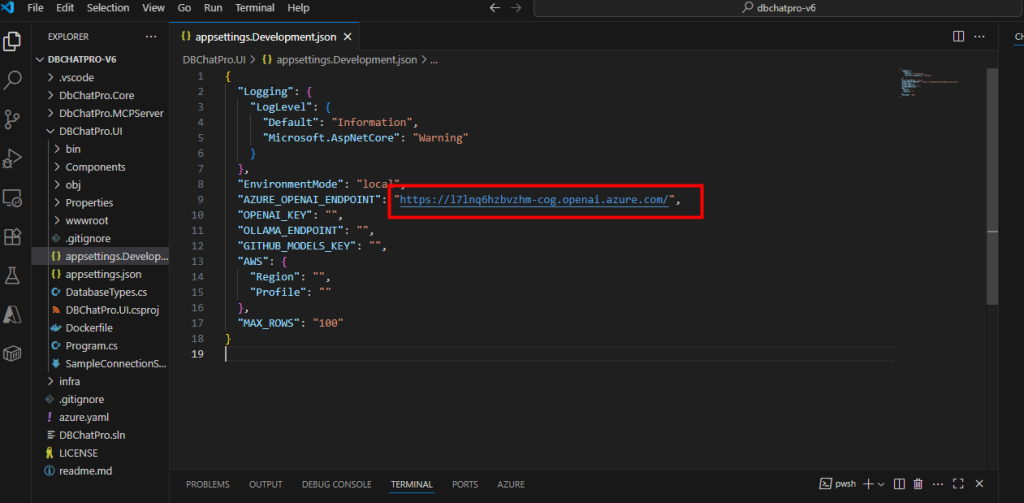

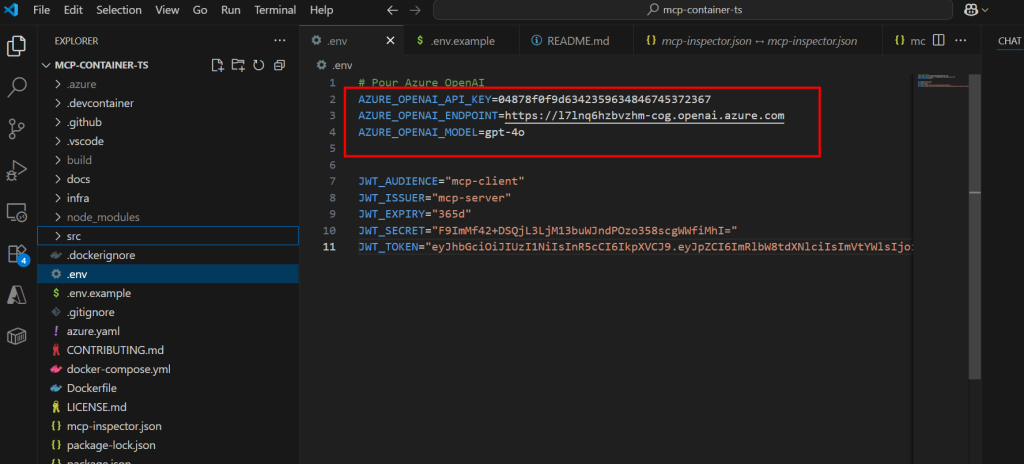

Ajoutez la ligne suivante pour renseigner le point de terminaison Azure OpenAI, puis sauvegardez :

# Azure OpenAI Configuration (optional but recommended for intelligent prompts)

AZURE_OPENAI_API_KEY=your-azure-openai-api-key-here

AZURE_OPENAI_ENDPOINT=https://your-resource-name.openai.azure.com

AZURE_OPENAI_MODEL=gpt-4o

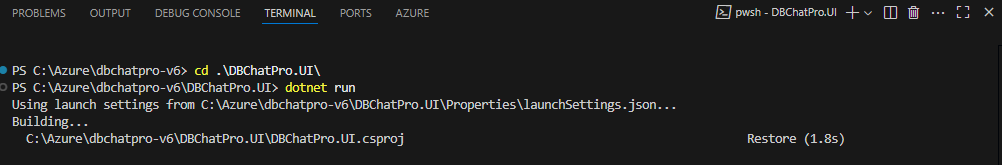

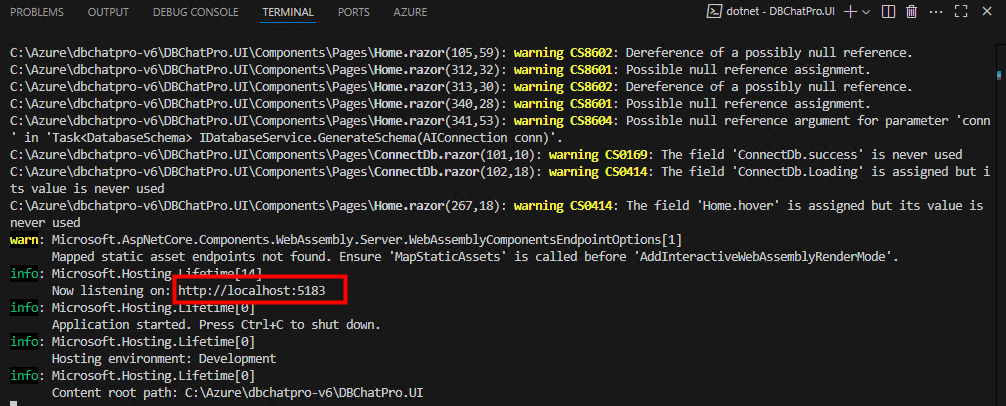

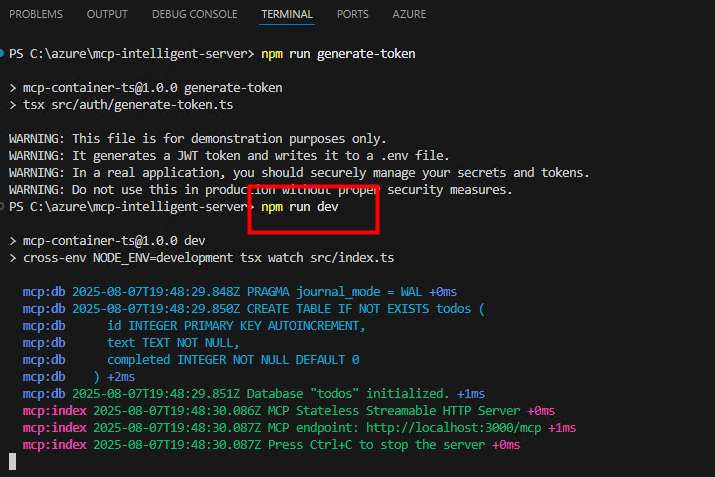

Lancez localement le serveur MCP avec la commande NPM suivante :

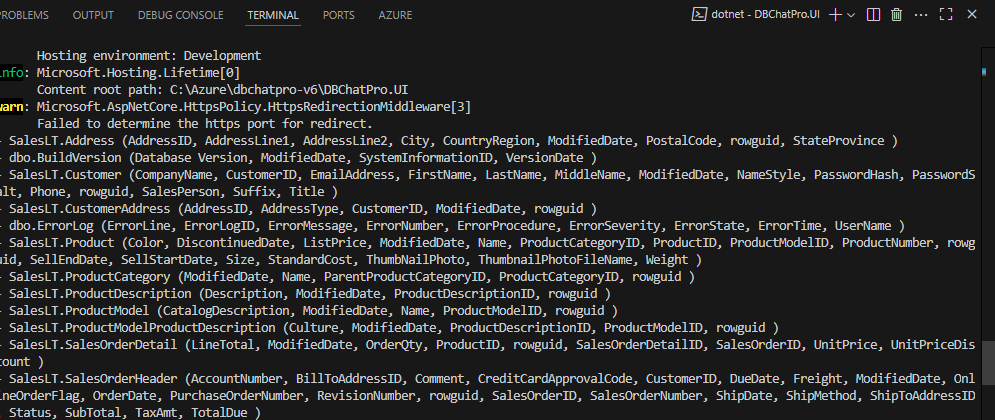

npm run devVérifiez la création de la base de données SQLite en mémoire, ainsi que le lancement réussi du serveur MCP :

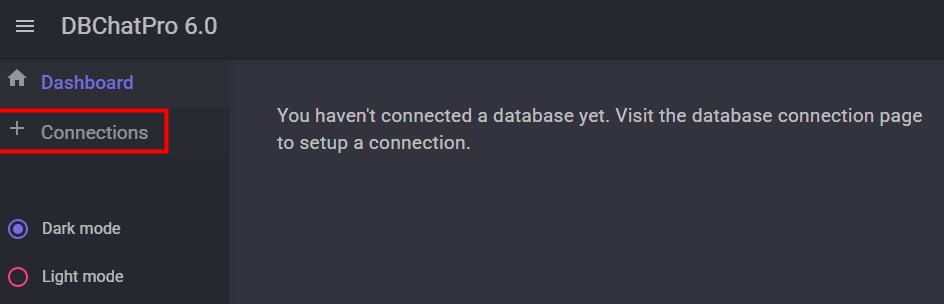

Notre environnement en local est maintenant déployé. Nous allons maintenant utiliser MCP Inspector pour explorer les fonctionnalités du serveur MCP.

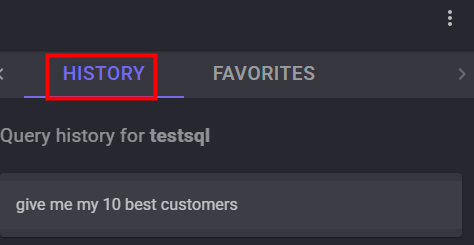

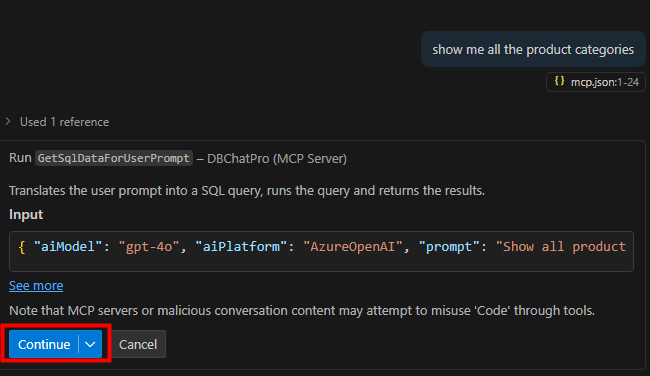

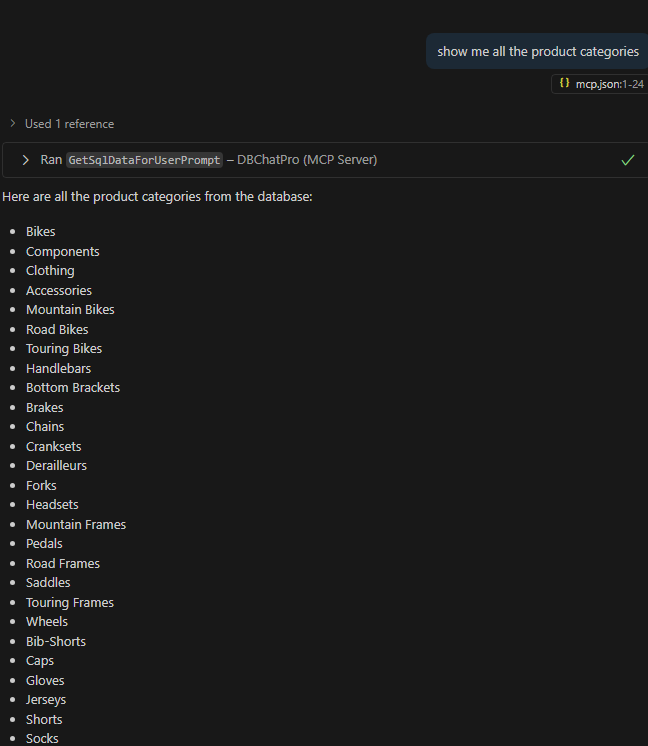

Etape II – Tests du serveur MCP local :

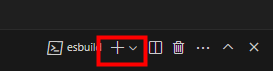

Ouvrez une seconde fenêtre de Terminal :

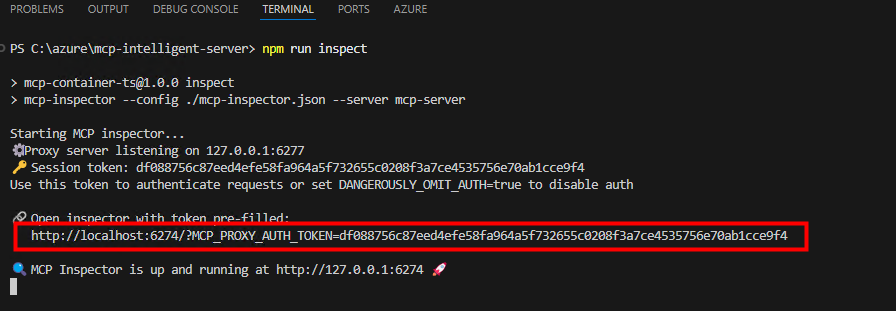

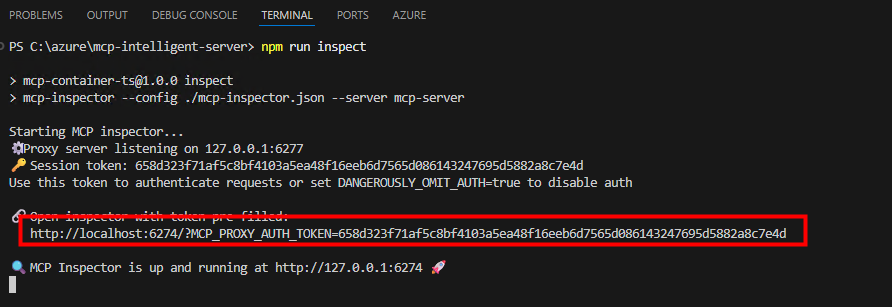

Lancez l’outil MCP Inspector avec la commande suivante :

npm run inspectRécupérez l’URL du proxy MCP Inspector contenant son propre token d’accès :

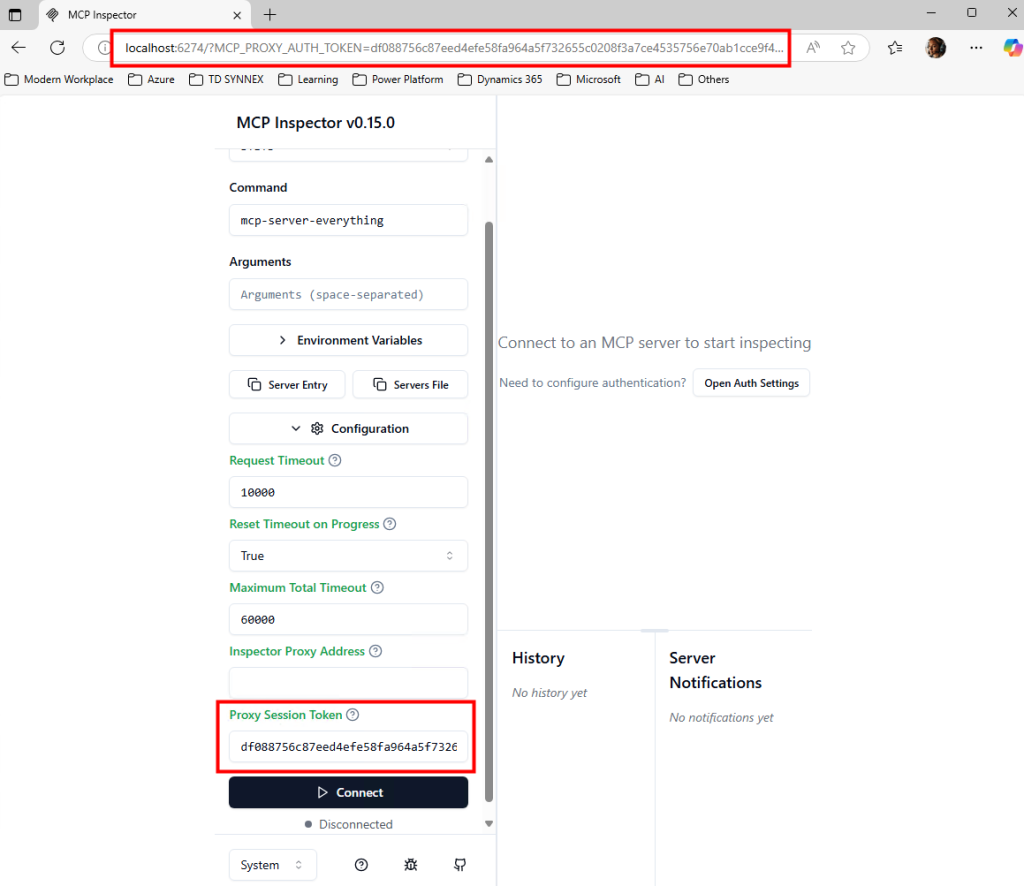

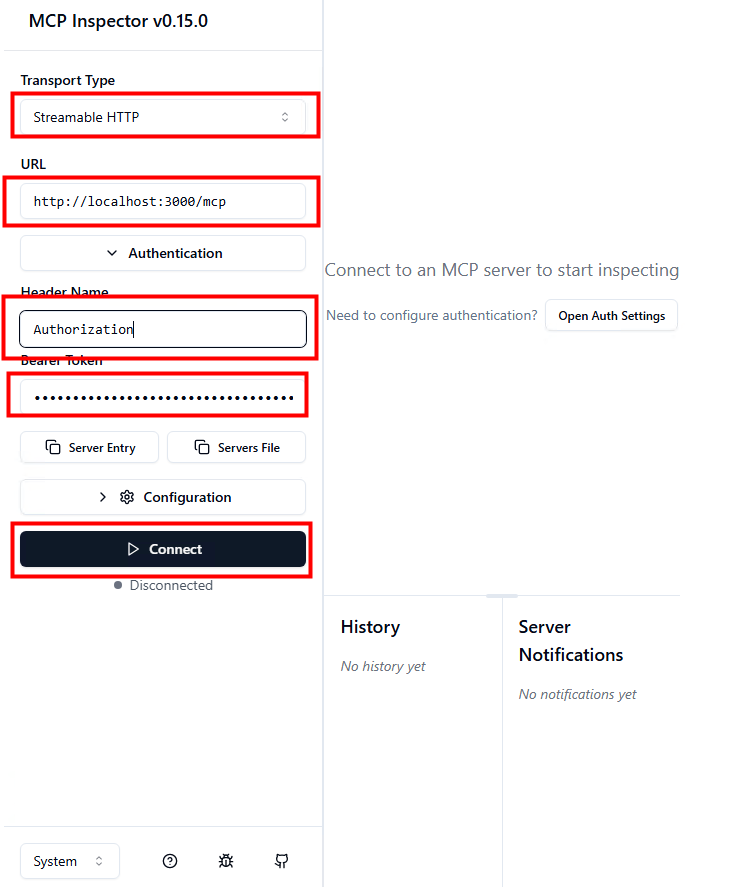

Ouvrez cette URL dans un navigateur et vérifiez la présence du token MCP Inspector :

Copiez ensuite la valeur du token du serveur MCP et ajoutez-la dans le fichier .env :

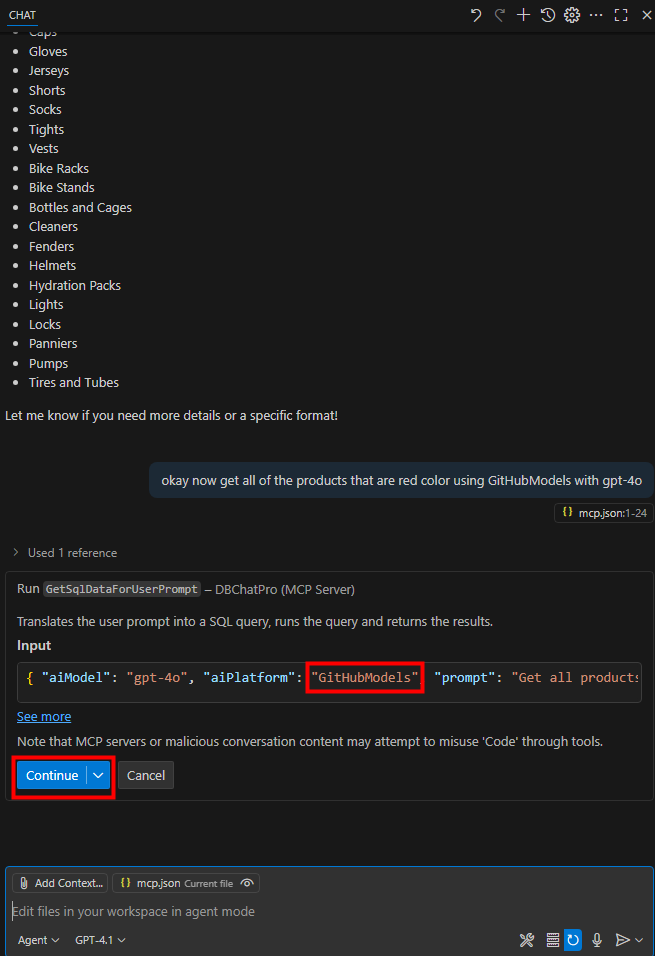

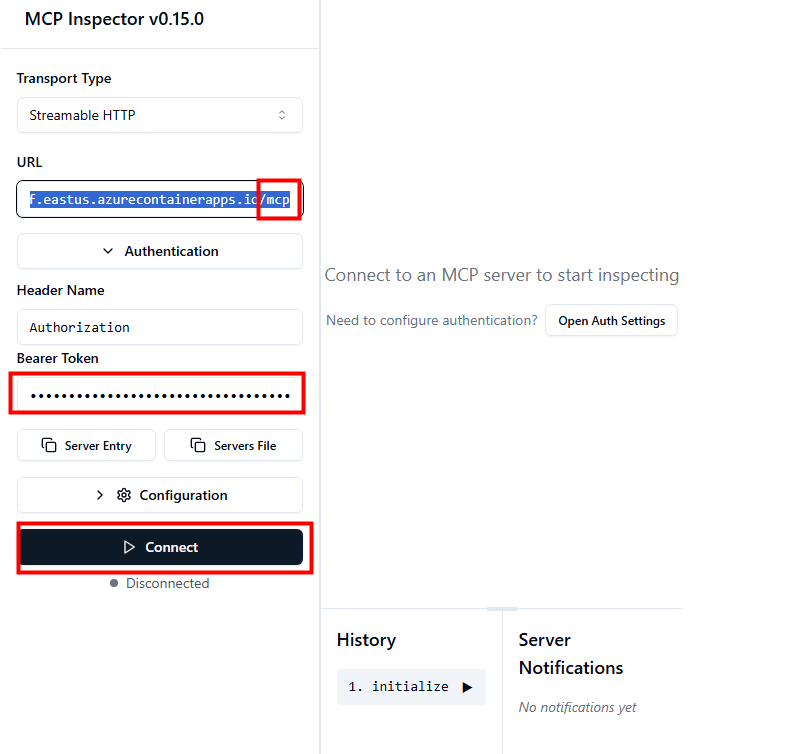

Complétez les champs requis pour la connexion au serveur MCP local, puis cliquez ici pour vous connecter :

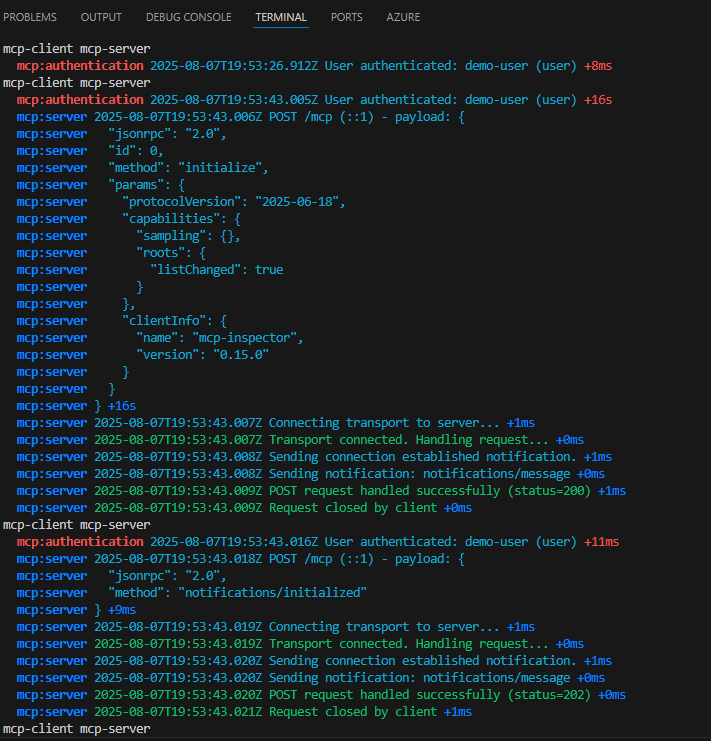

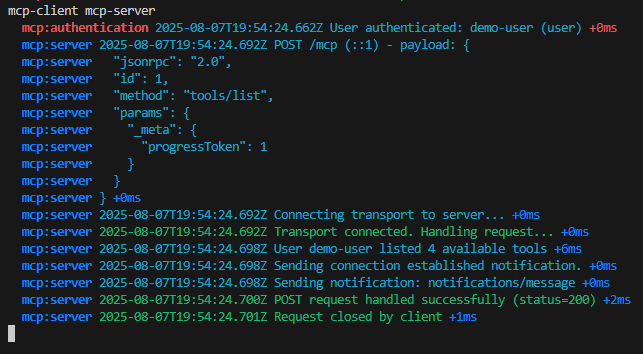

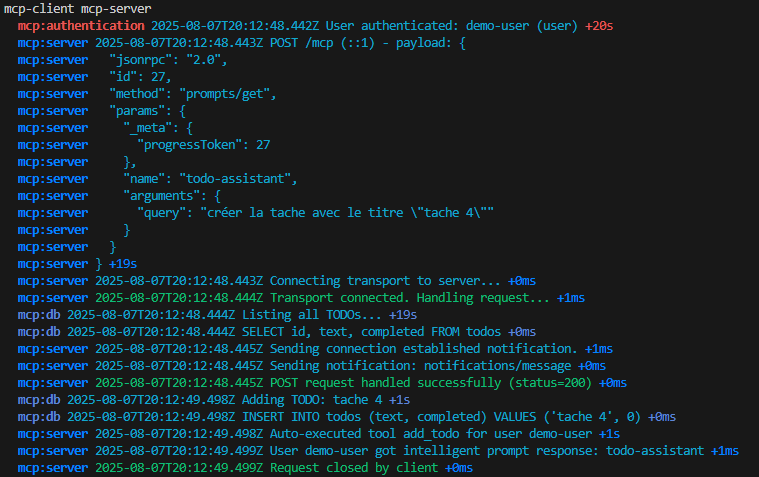

Vérifiez dans les logs l’authentification réussie du client vers le serveur MCP :

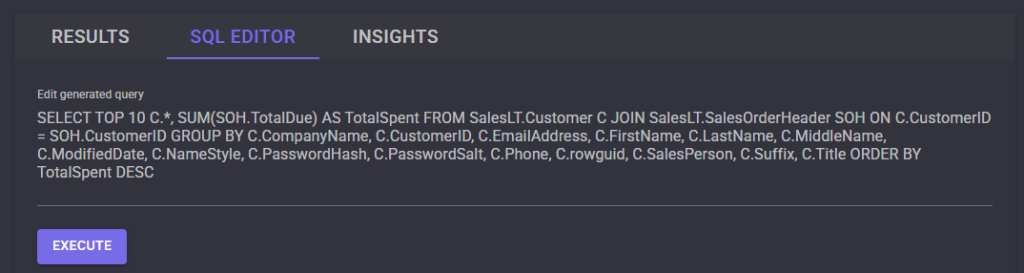

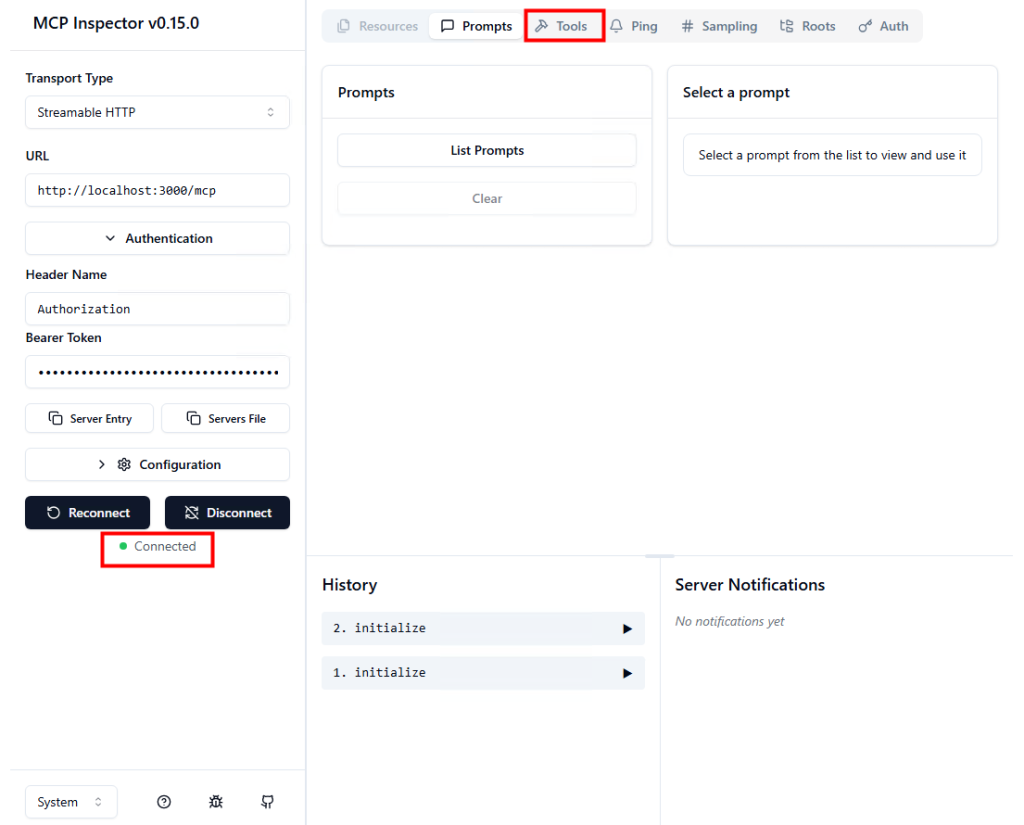

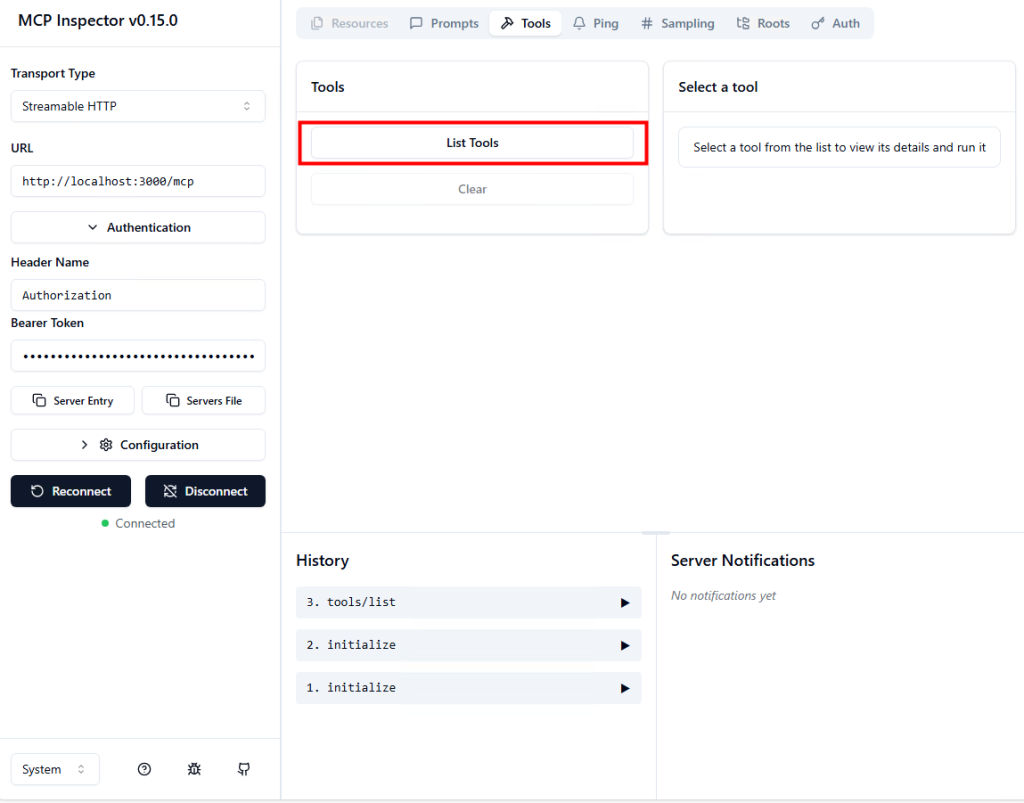

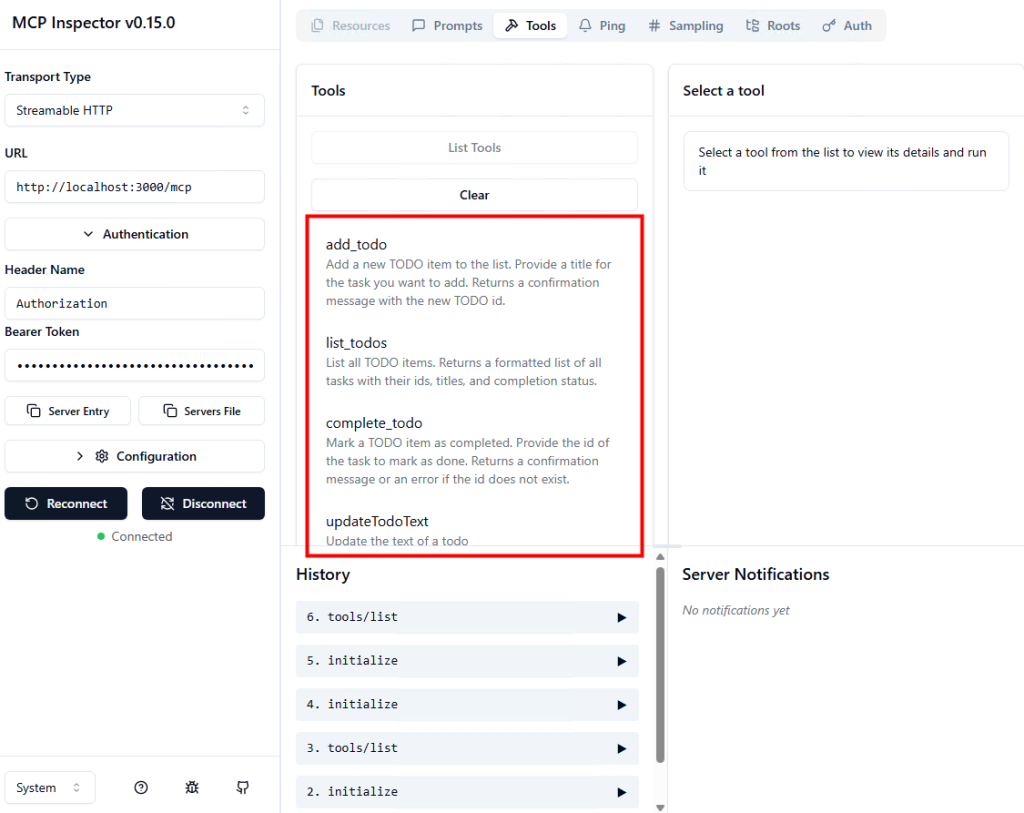

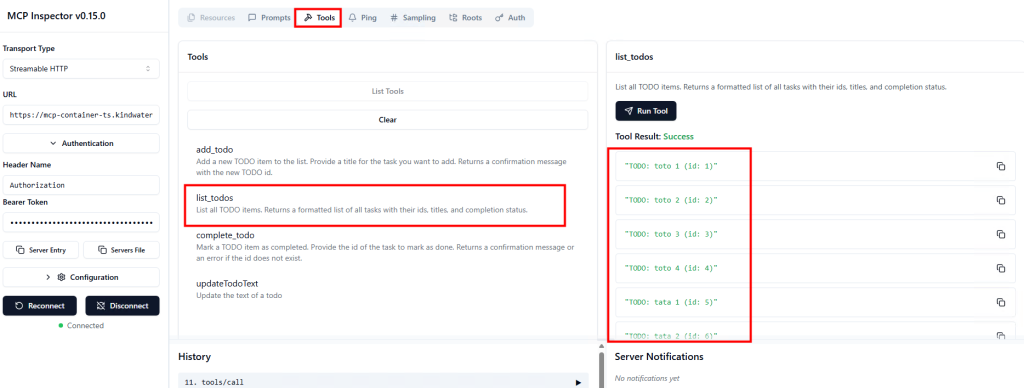

Dans MCP Inspector, vérifiez le statut Connected, puis cliquez sur l’onglet Tools :

Cliquez sur Lister les Tools pour afficher les outils déclarés :

Constatez l’apparition de la liste des outils disponibles :

Observez les opérations effectuées du côté du serveur MCP :

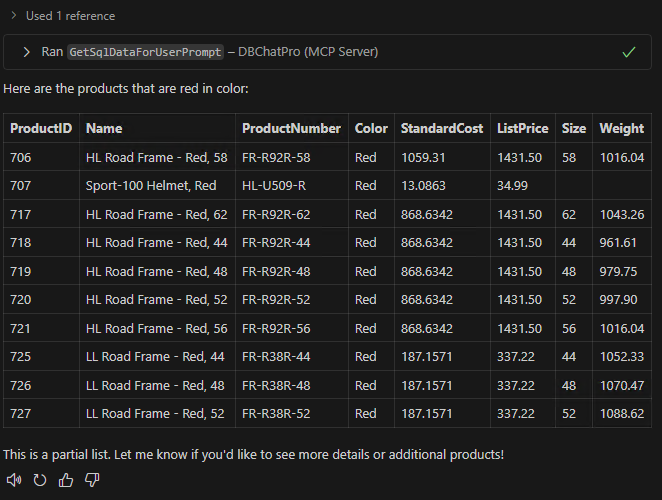

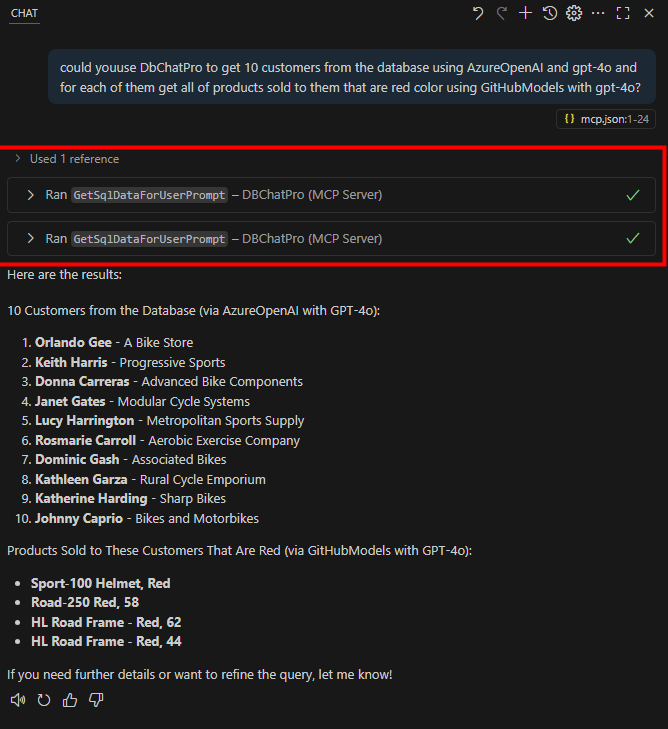

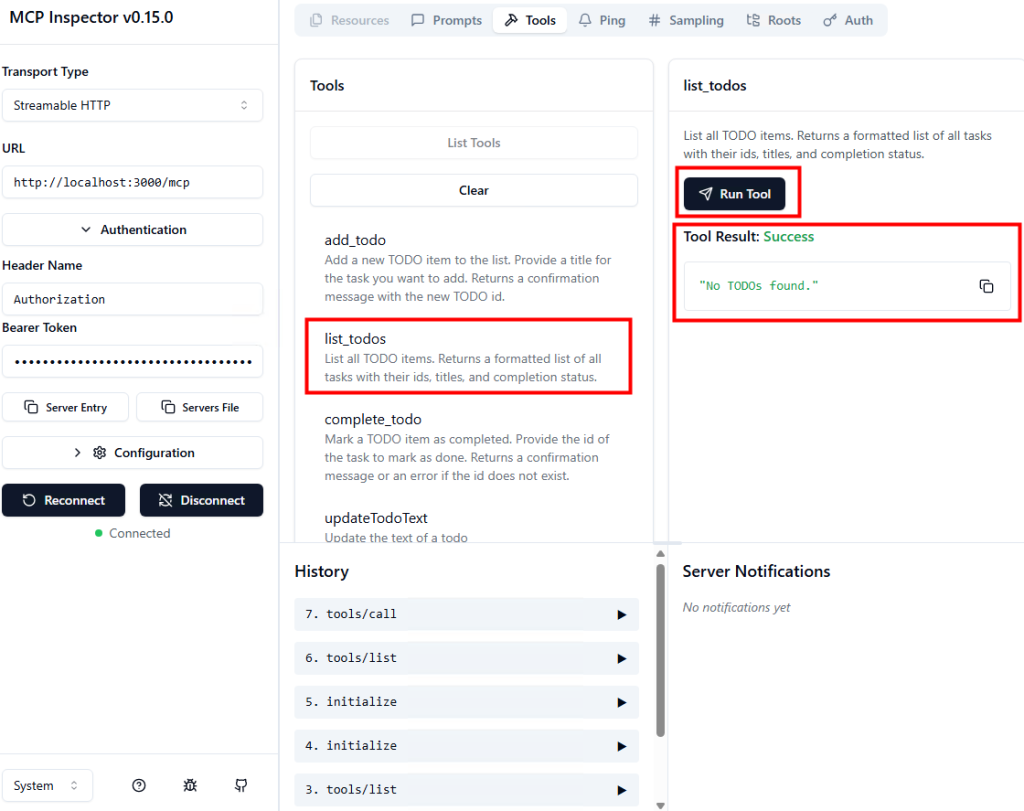

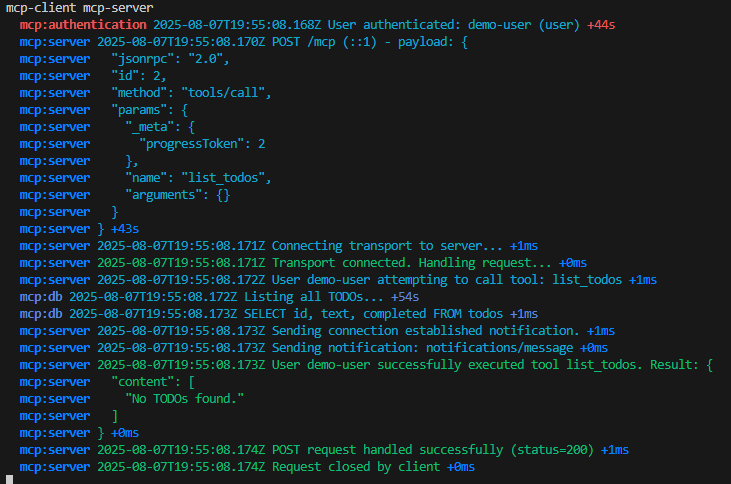

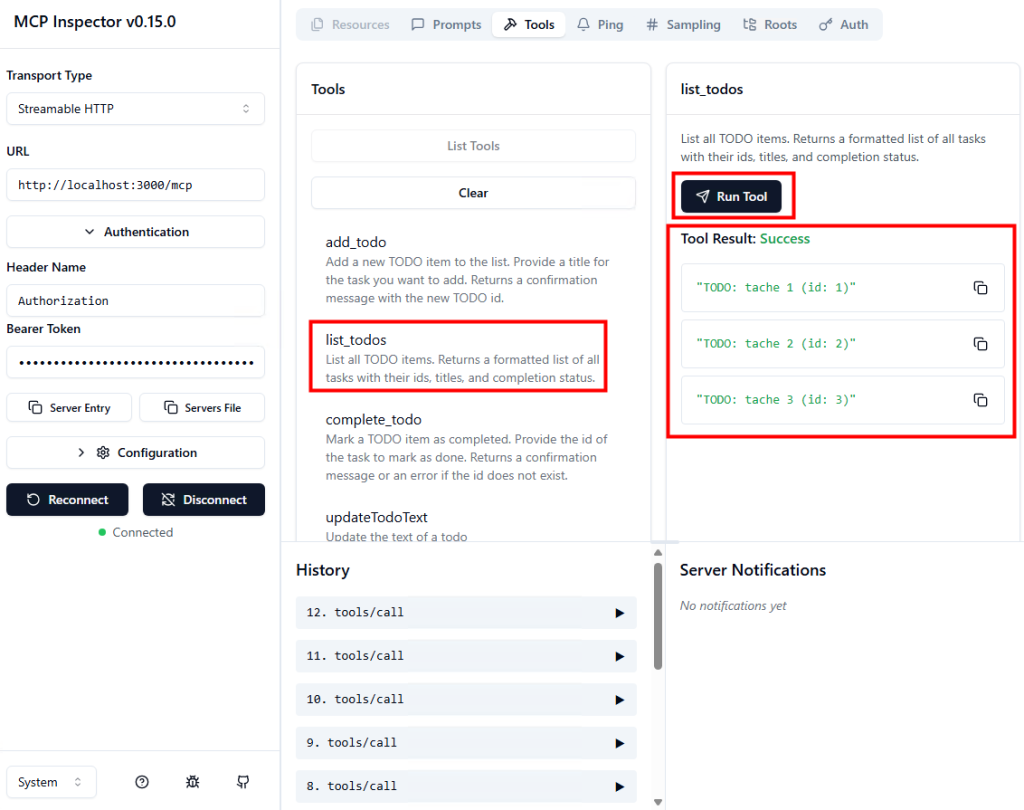

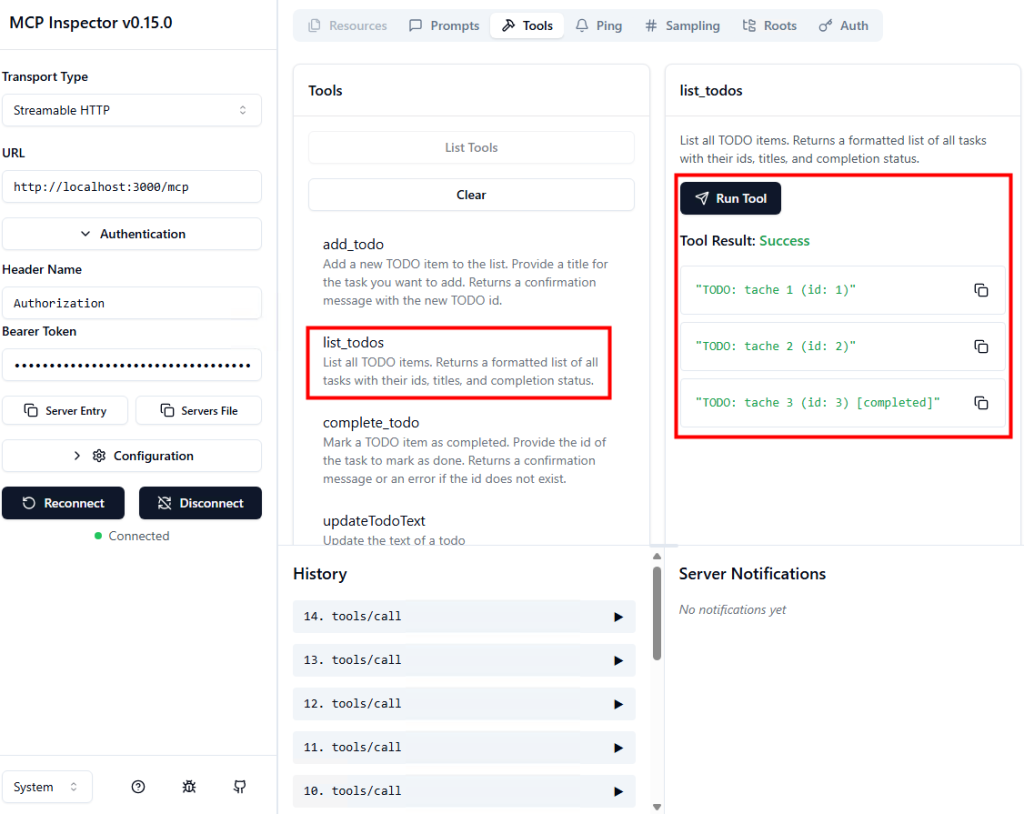

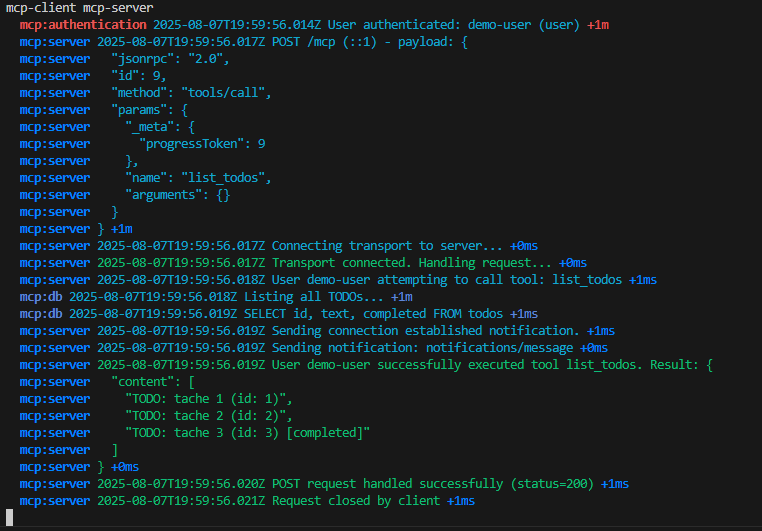

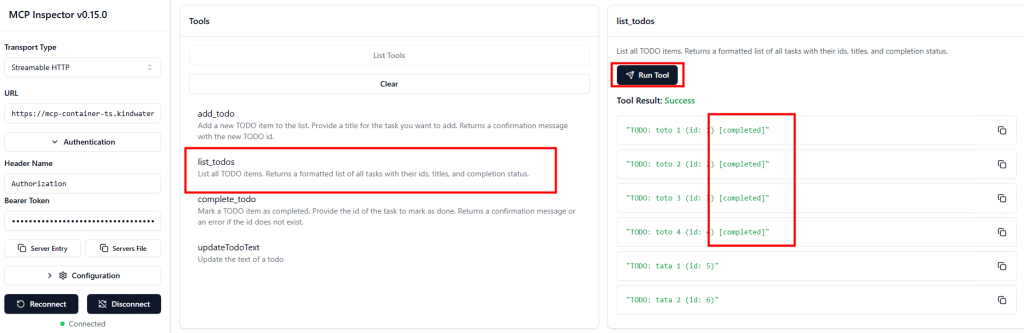

Utilisez l’outil List_ToDo, lancez-le et vérifiez le résultat obtenu :

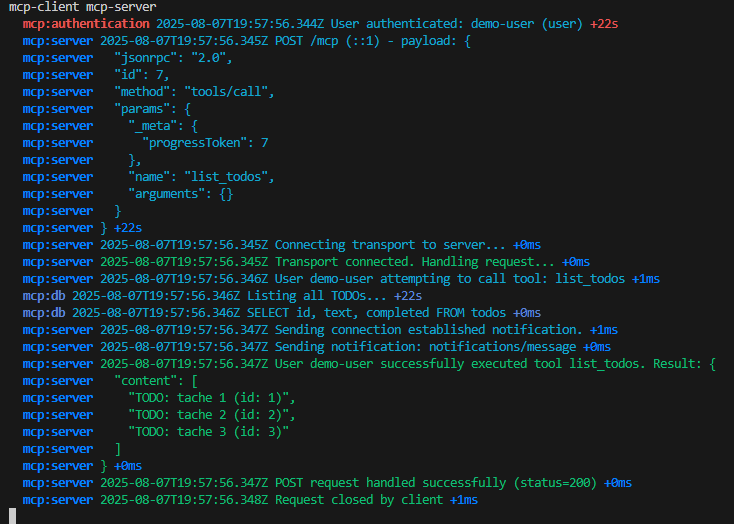

Analysez les logs générés par le serveur MCP pour cette opération :

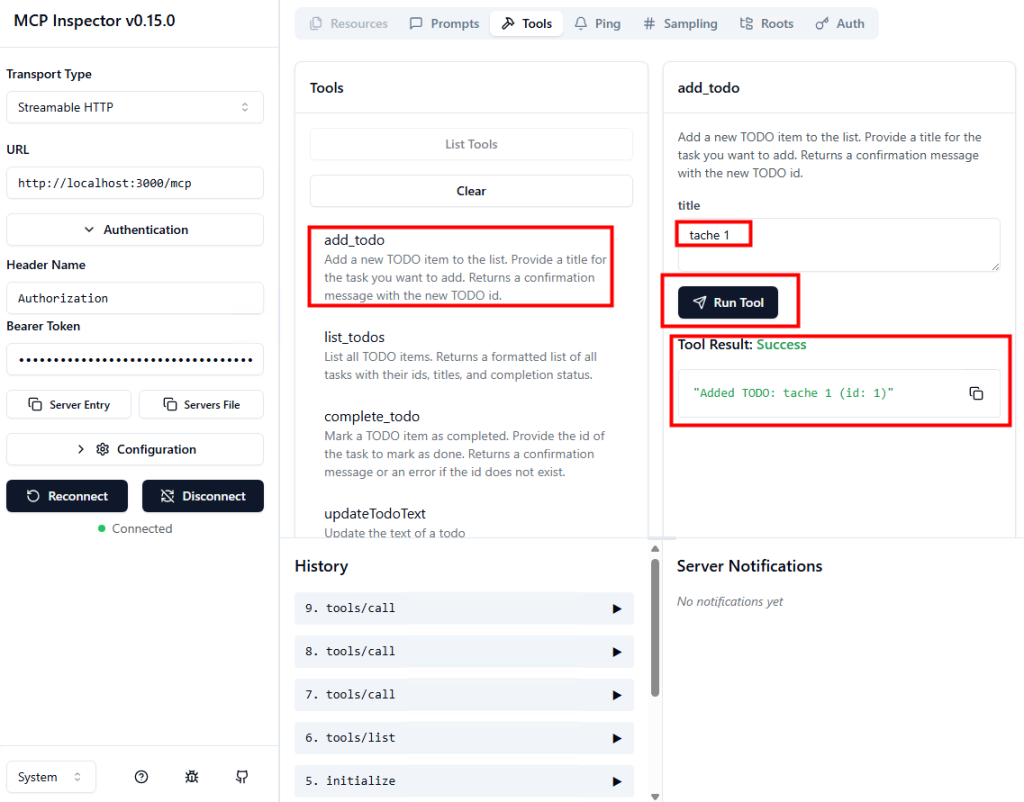

Utilisez l’outil Add _ToDo pour créer une nouvelle tâche, puis constatez l’opération :

Observez les logs correspondant à l’ajout de la nouvelle tâche dans la base SQLite :

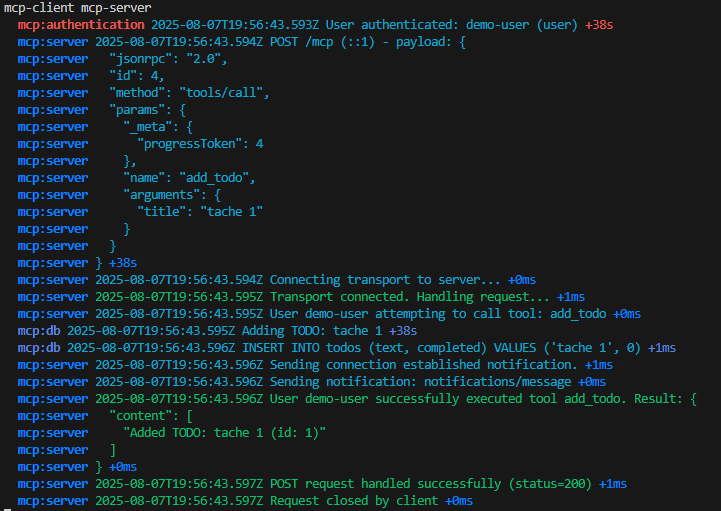

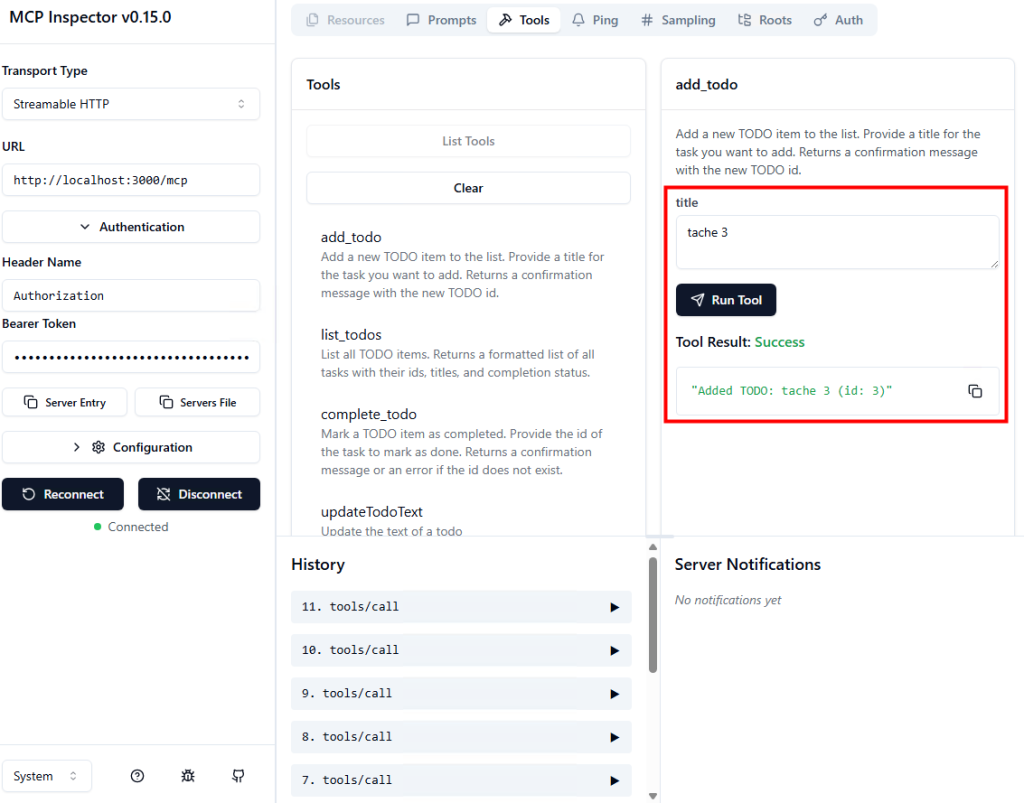

Ajoutez plusieurs tâches supplémentaires :

Relancez List_ToDo :

Analysez les logs générés par le serveur MCP pour cette opération :

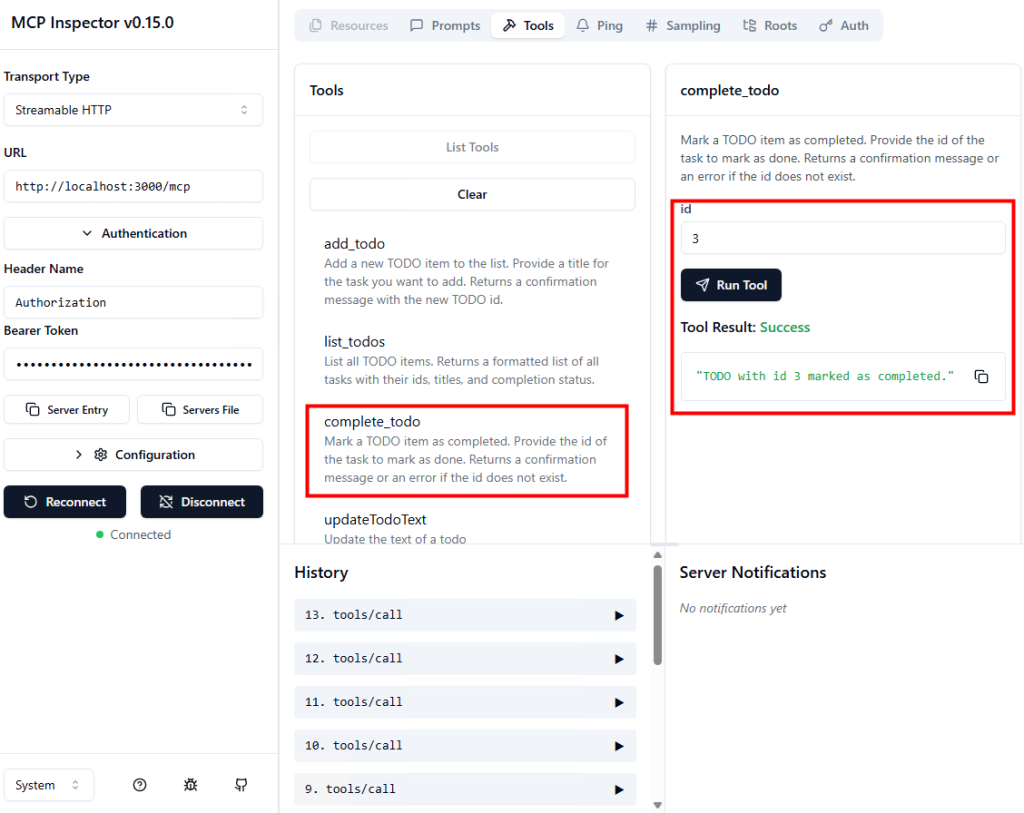

Utilisez Complete_ToDo pour marquer une tâche comme complétée :

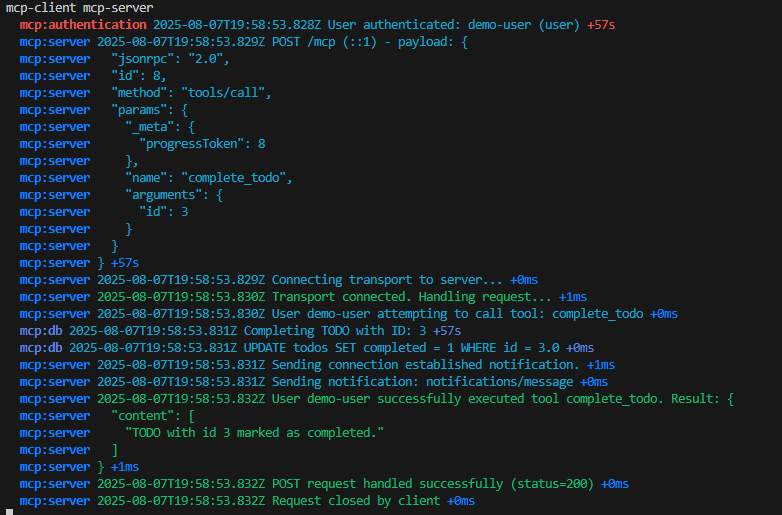

Vérifiez les logs correspondant à cette mise à jour :

Relancez List_ToDo pour constater que la tâche est complétée :

Observez les logs correspondant à cette liste mise à jour :

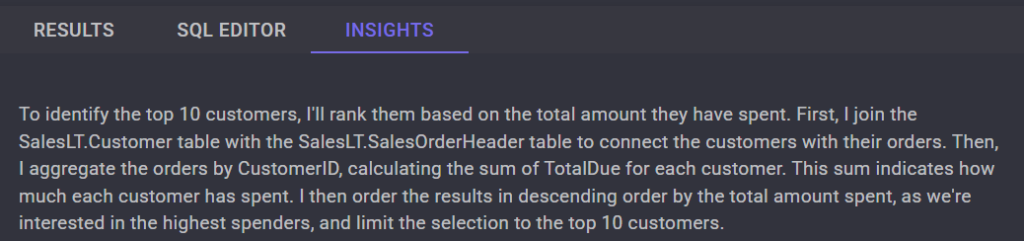

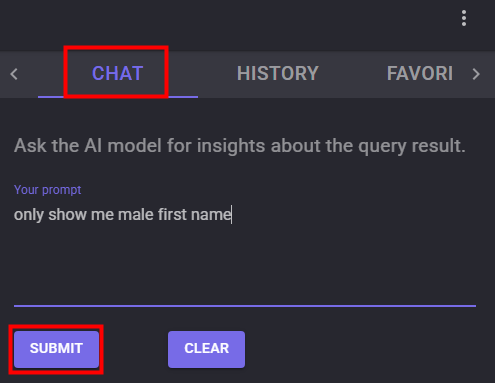

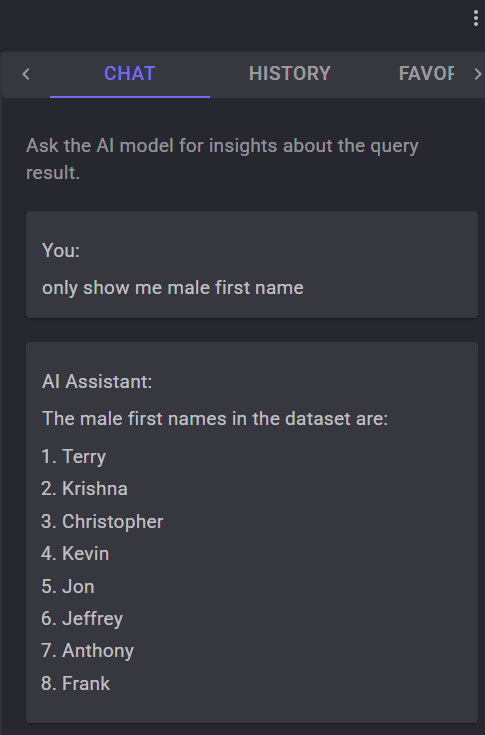

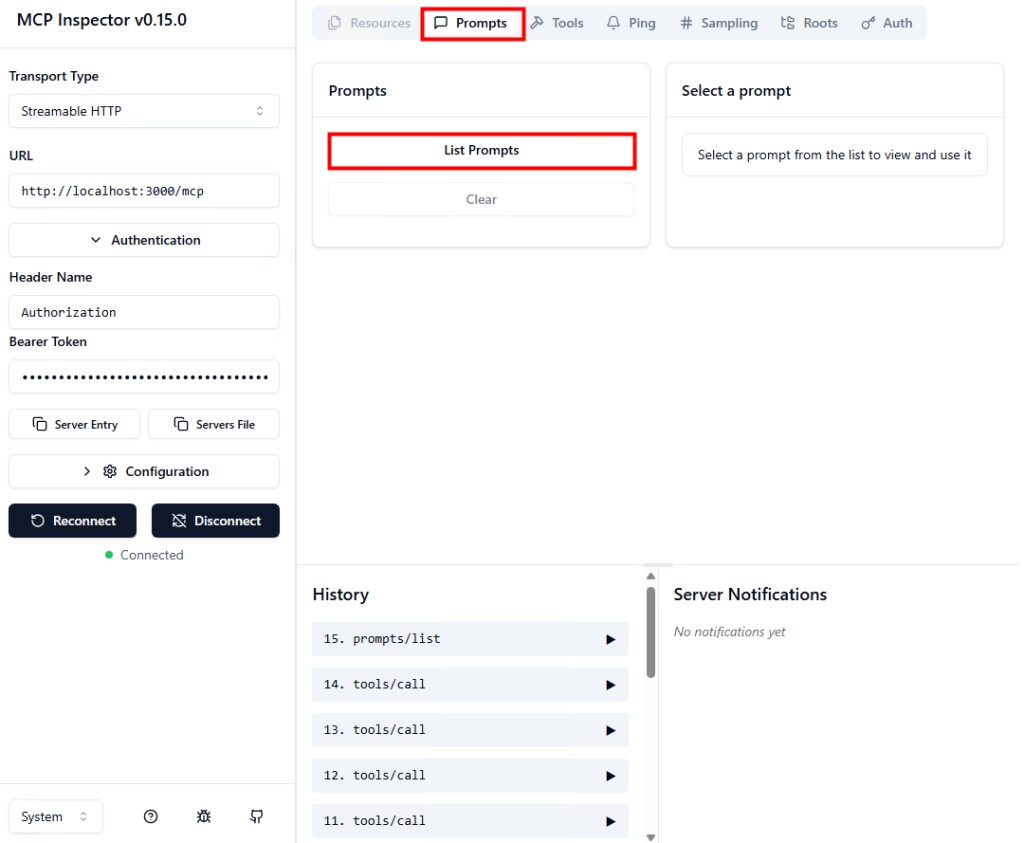

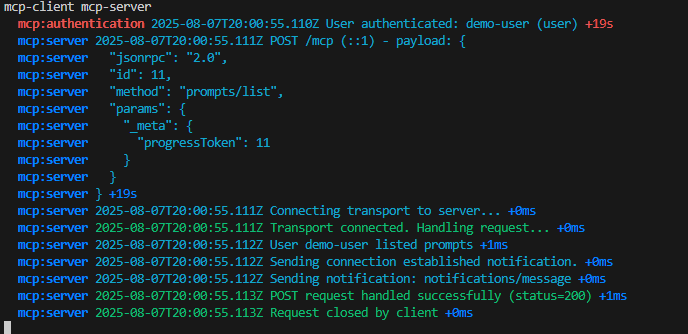

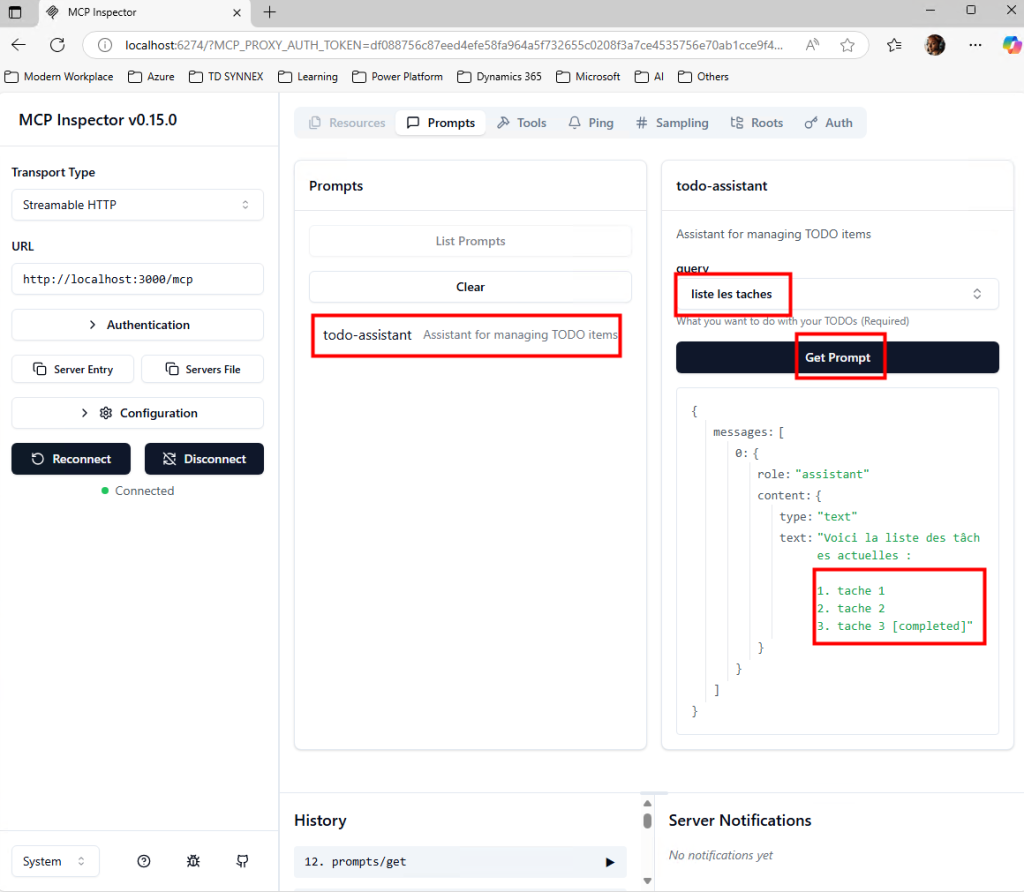

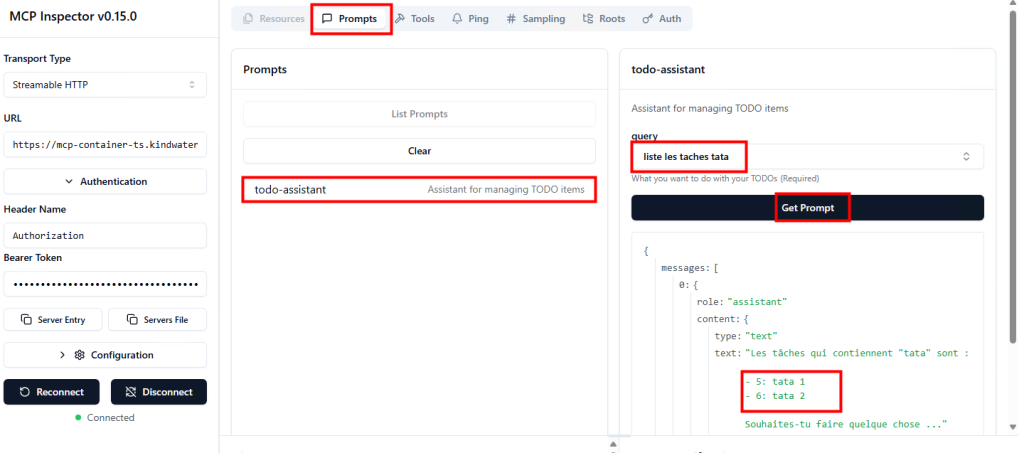

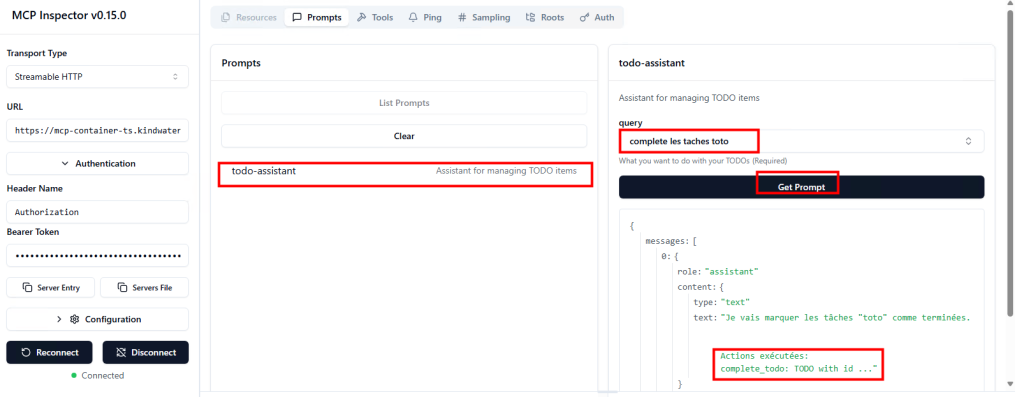

Passez à l’onglet Prompts, puis cliquez ici pour lister les assistants IA disponibles :

Vérifiez les logs générés par cette action :

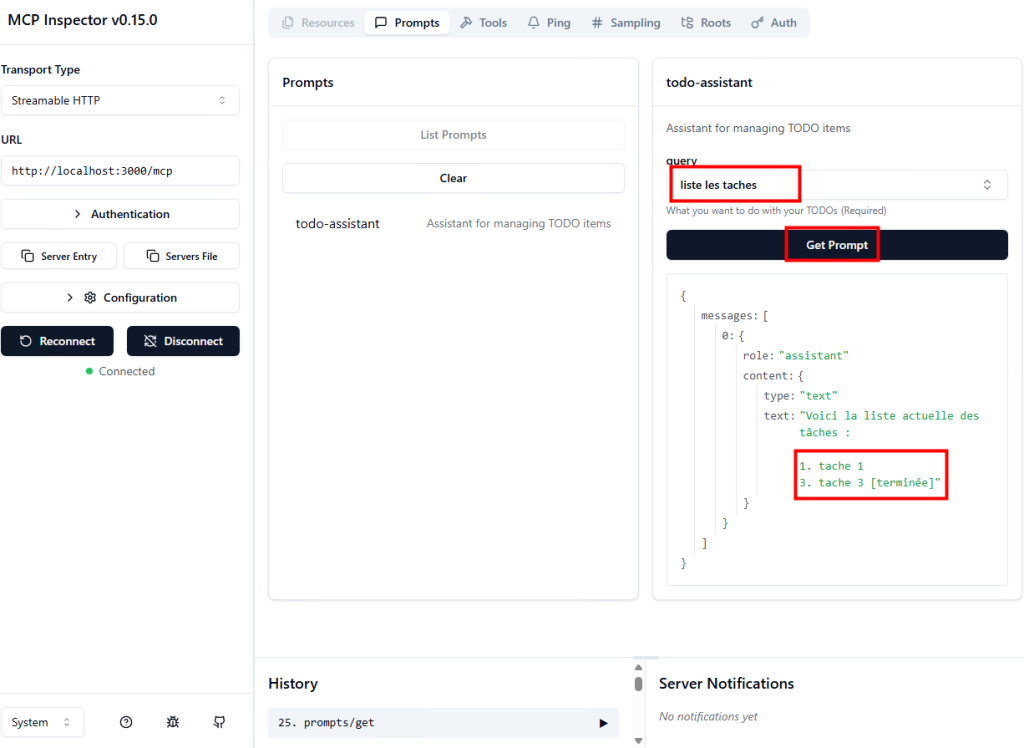

Cliquez sur ToDo Assistant, entrez un exemple de requête (ex. : lister les tâches), puis constatez la réponse générée :

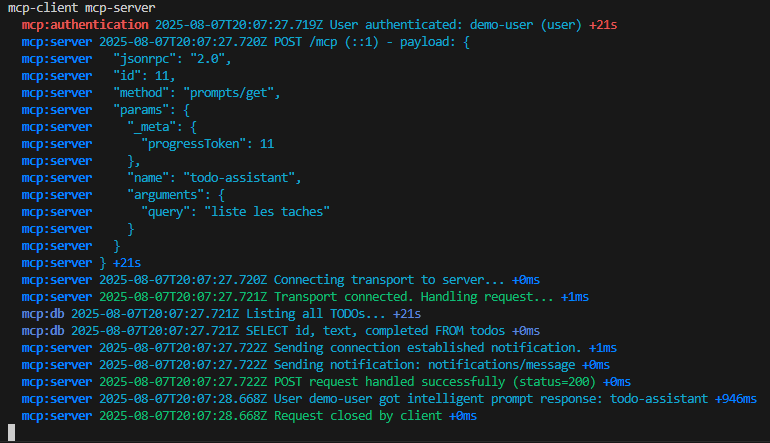

Observez les logs correspondant à ce prompt :

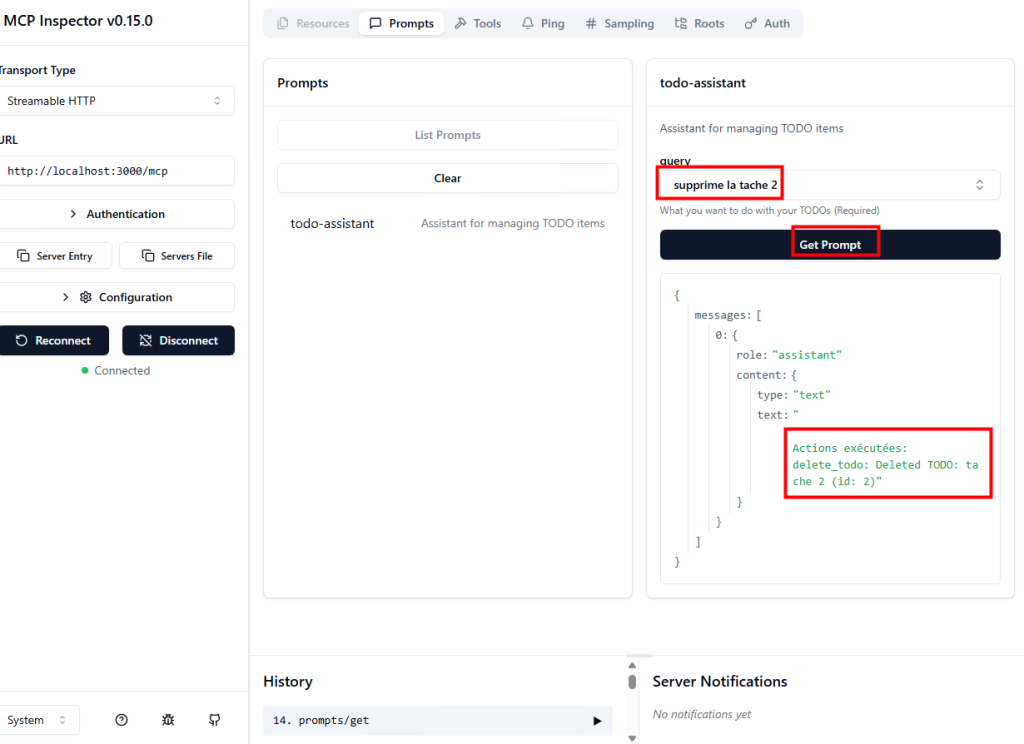

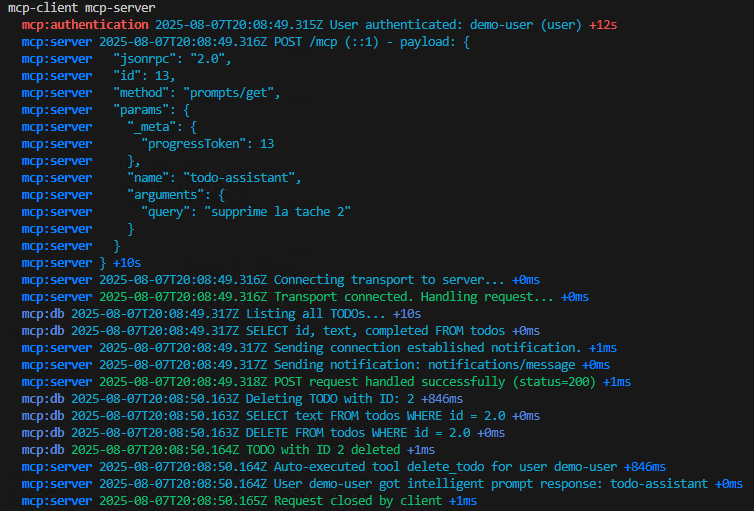

Testez un prompt de suppression d’une tâche, puis exécutez-le :

Vérifiez les logs générés et l’action effectuée sur la base SQLite :

Relancez List_ToDo pour constater que la tâche a bien été supprimée :

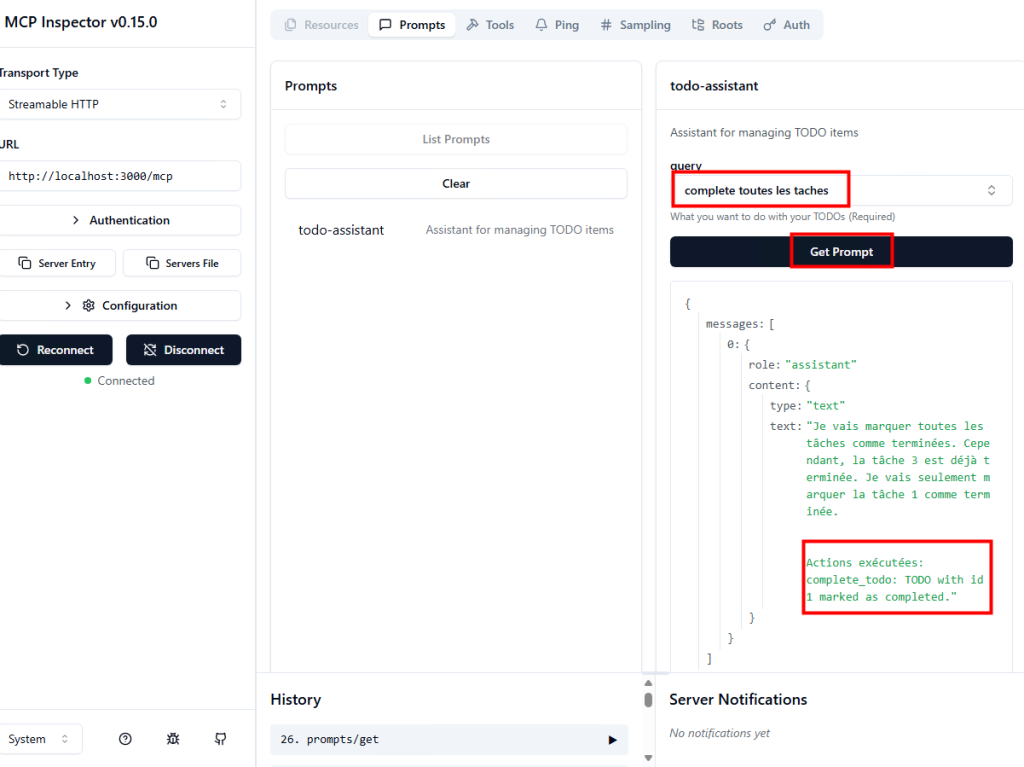

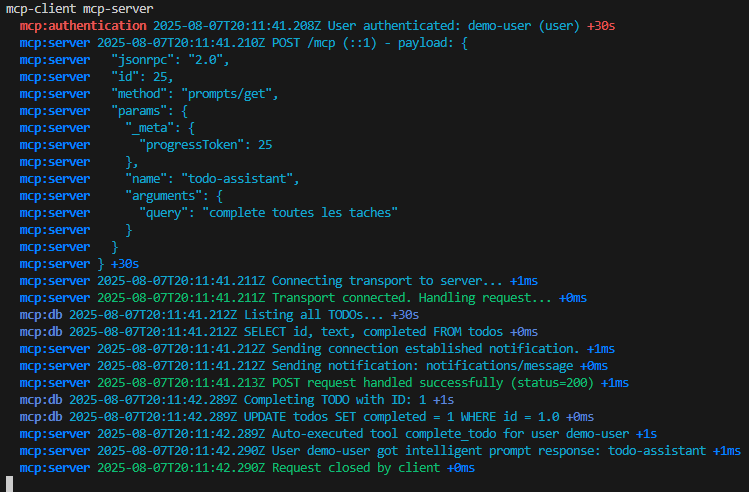

Testez un prompt de mise à jour de toutes les tâches :

Constatez le résultat dans les logs :

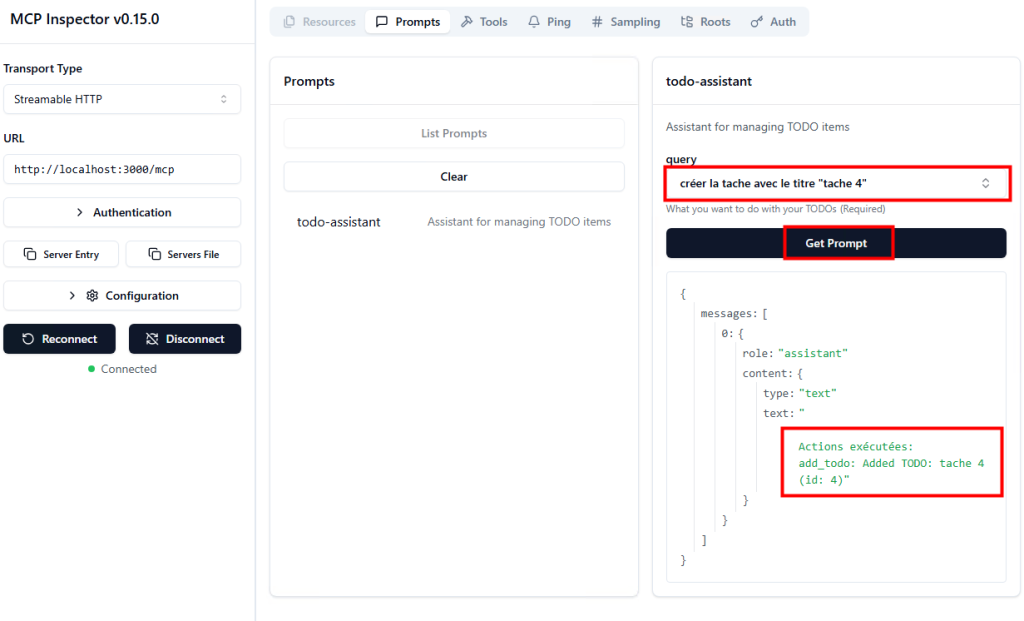

Créez une nouvelle tâche via un prompt :

Observez les logs correspondant à l’ajout de cette nouvelle tâche :

La démonstration sur l’environnement local est terminée, passons maintenant au déploiement sur Azure.

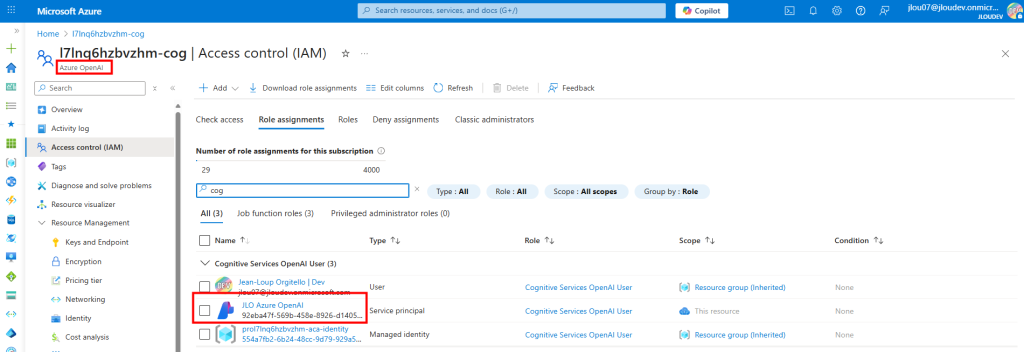

Etape III – Déploiement du serveur MCP sur Azure :

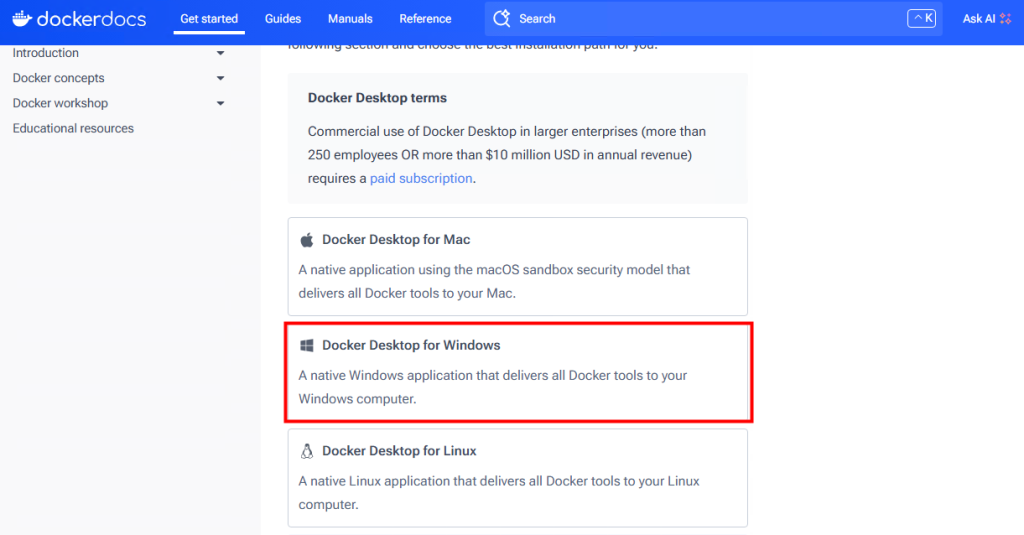

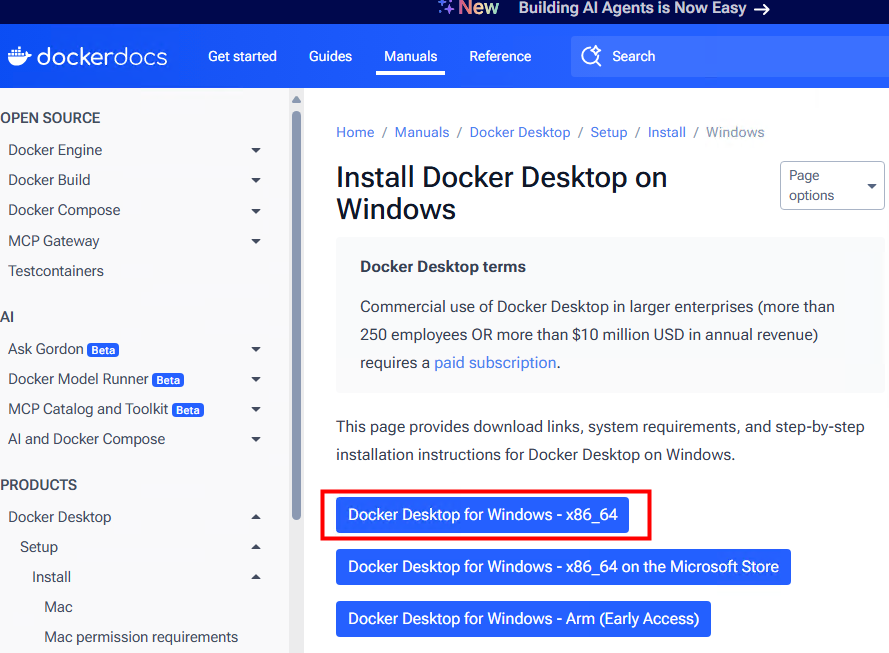

Rendez-vous sur l’URL de téléchargement de Docker Desktop, puis téléchargez la version correspondant à votre OS :

Lancez l’exécutable compatible avec votre architecture :

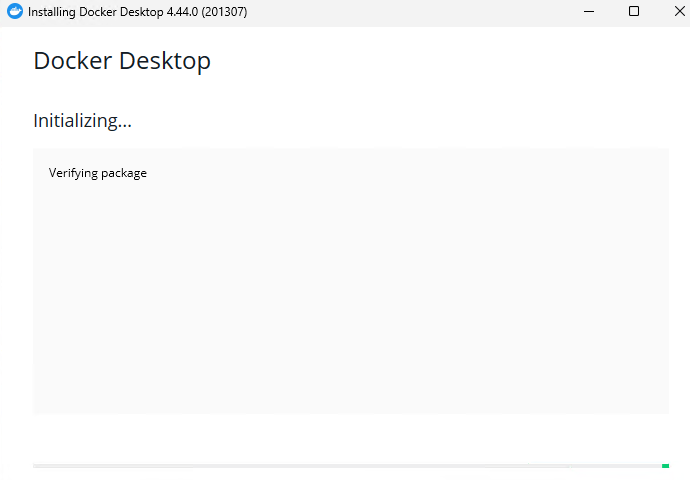

Suivez l’installation :

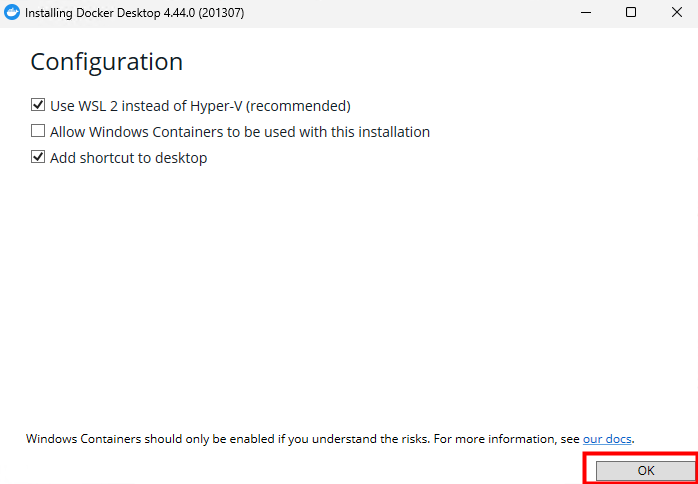

Cochez les options proposées puis cliquez sur OK :

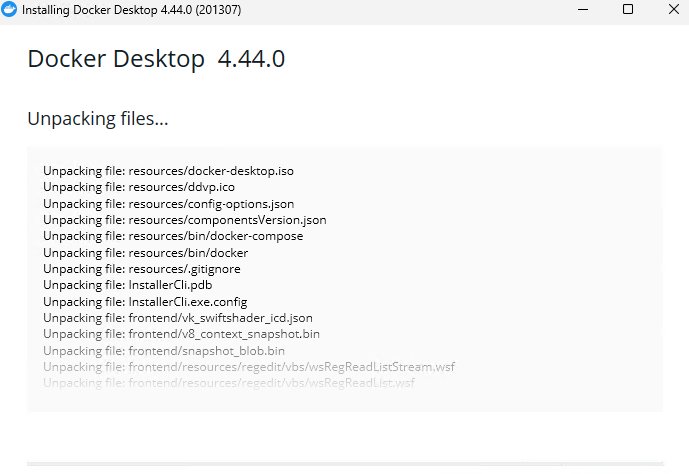

Attendez la fin de l’installation (de 5 à 10 minutes) :

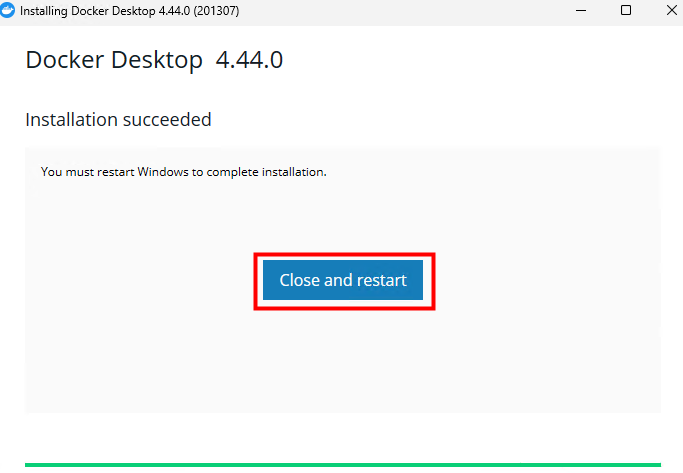

Cliquez sur Fermer, puis redémarrez l’ordinateur :

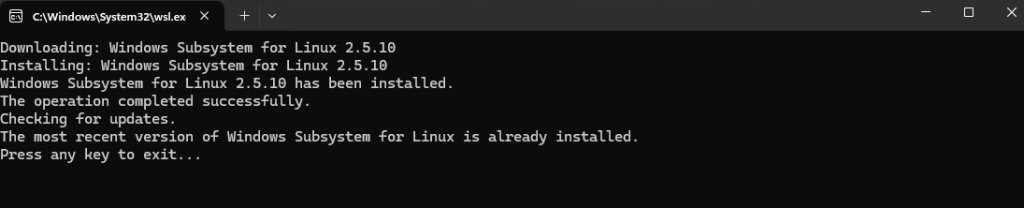

Après le redémarrage, ouvrez Docker Desktop, puis laissez le téléchargement des composants additionnels se terminer :

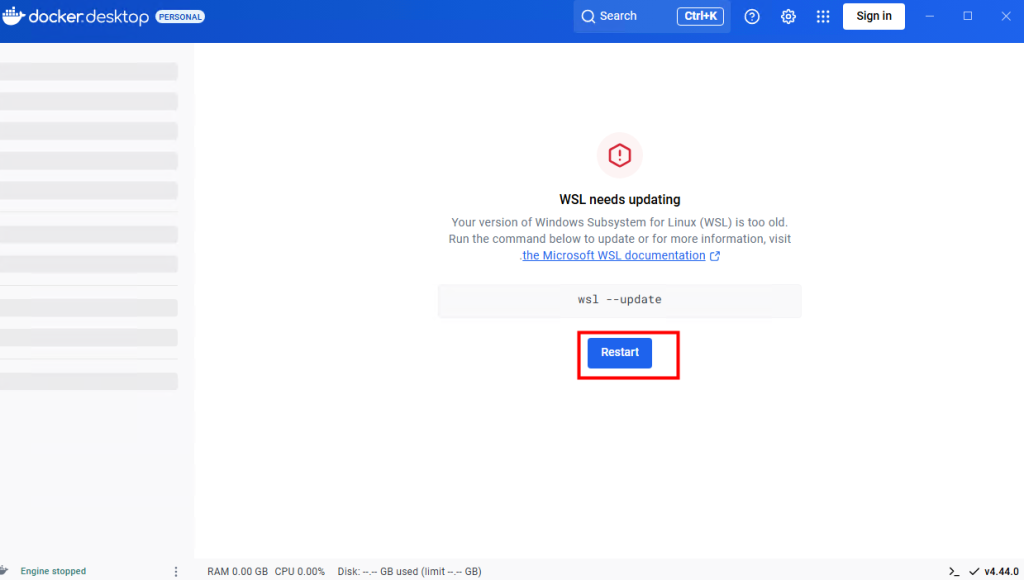

Patientez si des mises à jour sont nécessaires, puis redémarrez si demandé :

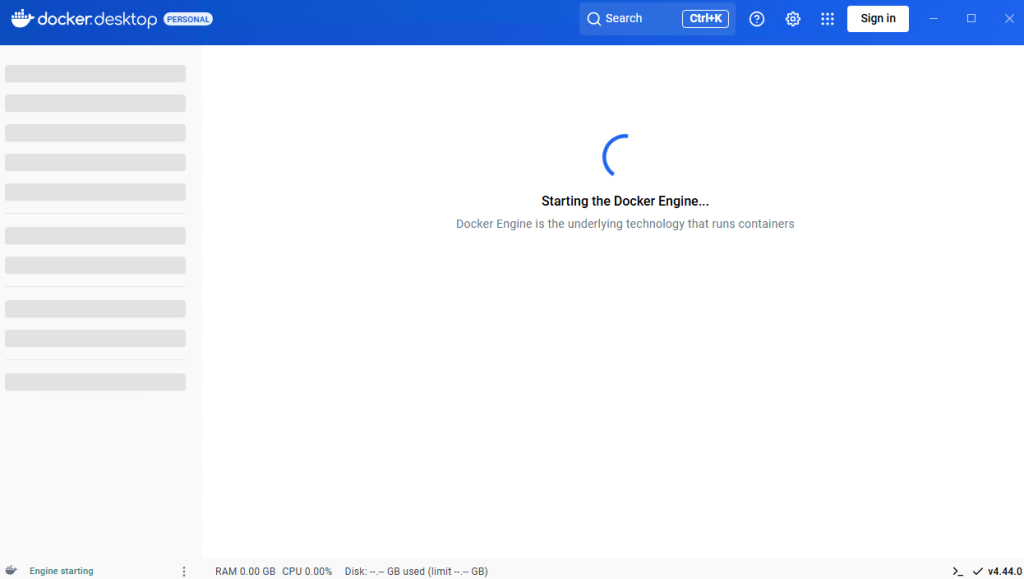

Attendez le démarrage complet de Docker Engine :

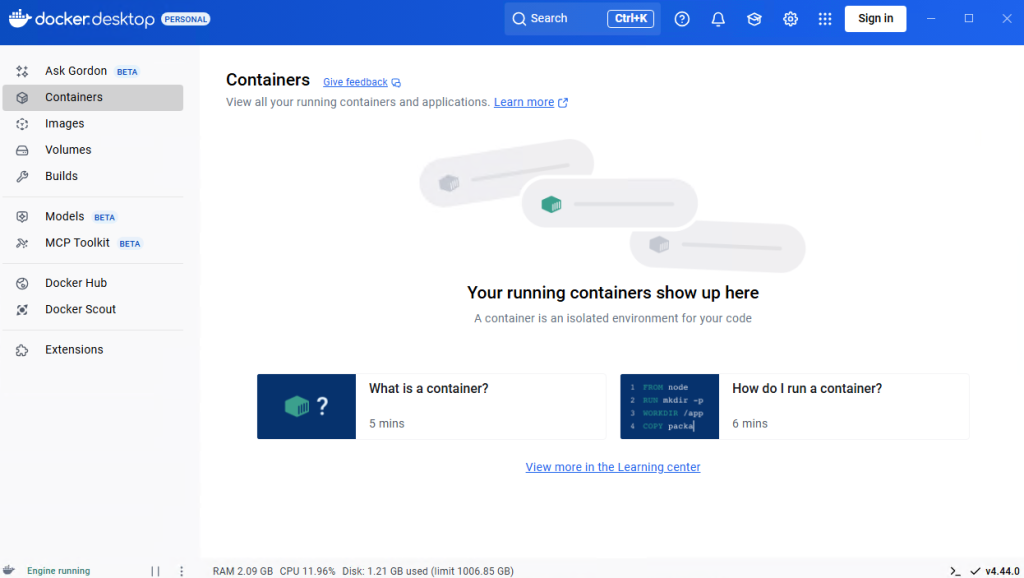

Vous devez voir l’écran principal de Docker Desktop avec un tableau de bord vide de conteneurs :

Ouvrez Visual Studio Code, puis ouvrez un nouveau terminal :

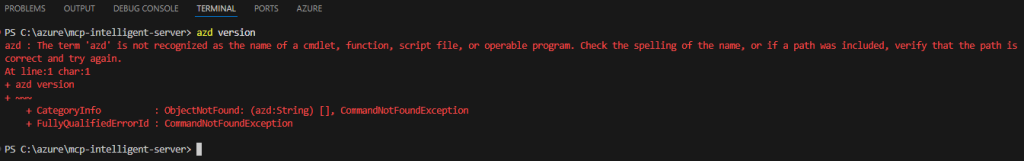

Lancez la commande azd pour vérifier si Azure Developer CLI est installé :

azd version

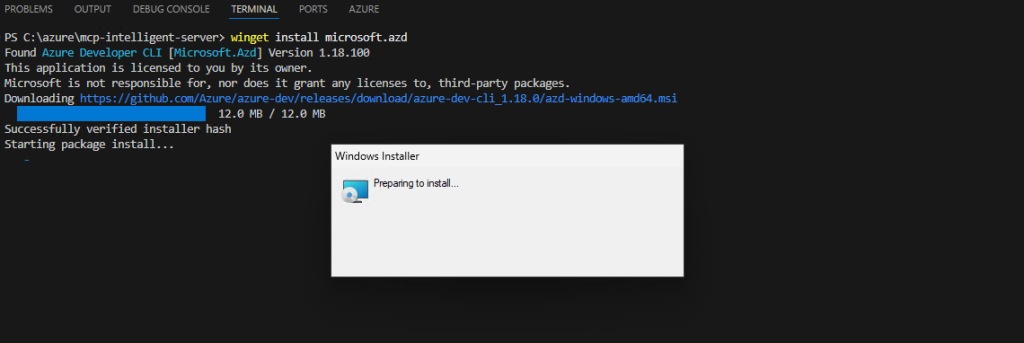

Si Azure Developer CLI n’est pas installé, exécutez la commande pour l’installer :

winget install microsoft.azdAttendez la fin de l’installation :

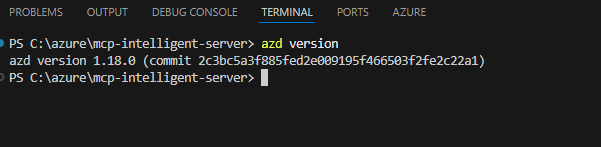

Fermez puis rouvrez Visual Studio Code et vérifiez que azd est bien installé :

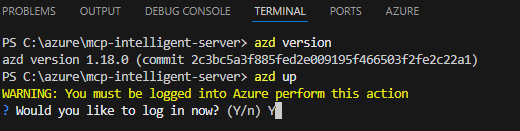

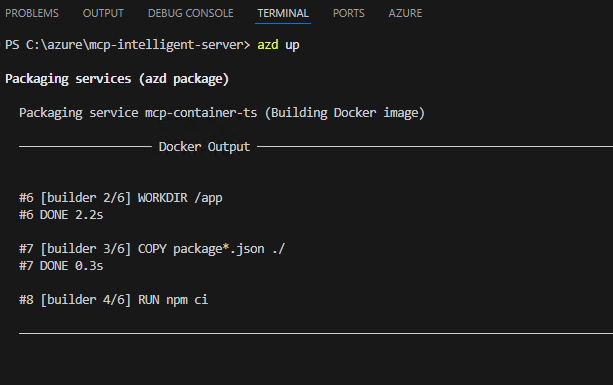

Depuis le dossier du serveur MCP, lancez la commande azd up pour déployer l’infrastructure sur Azure :

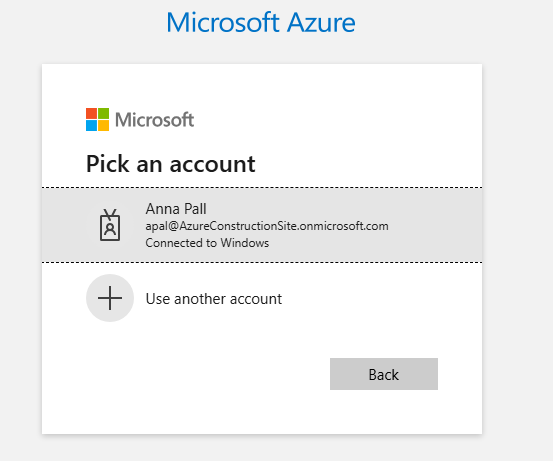

Connectez-vous avec votre compte Azure :

Patientez pendant la préparation de l’image du conteneur :

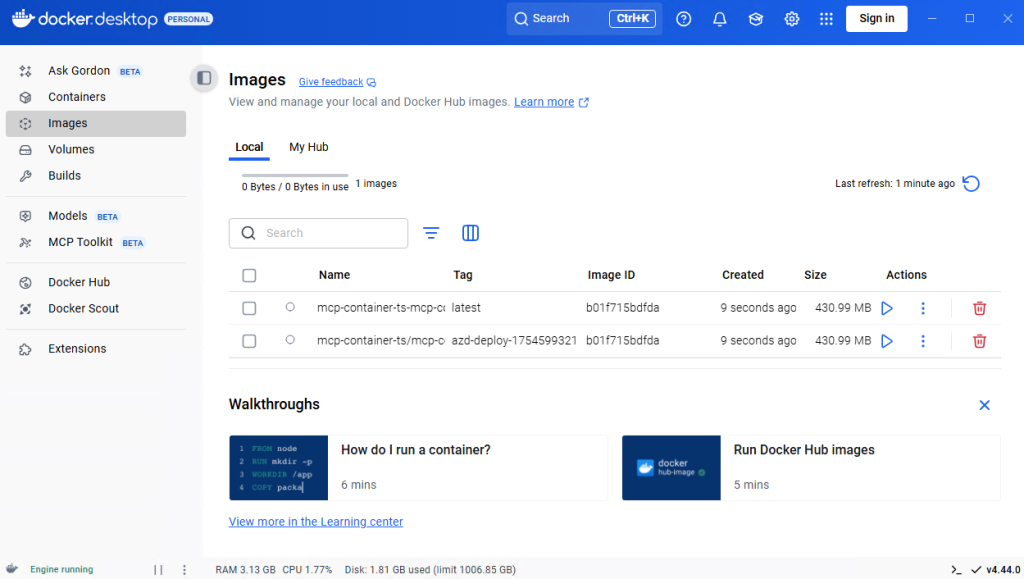

Constatez la création locale des images Docker dans Docker Desktop :

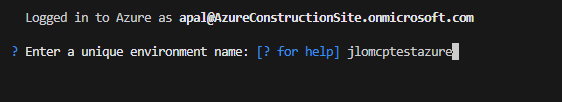

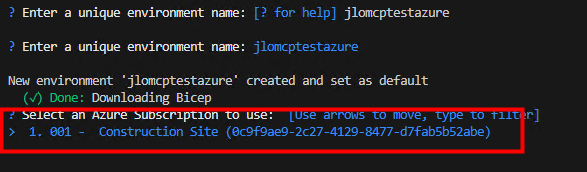

Donnez un nom à votre application unique sur Azure :

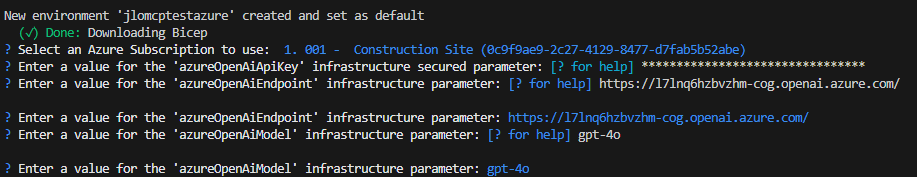

Choisissez votre souscription Azure :

Saisissez les informations liées à Azure OpenAI :

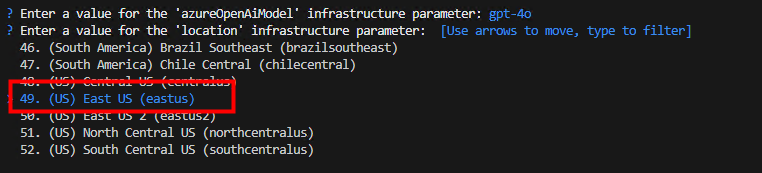

Sélectionnez la région Azure :

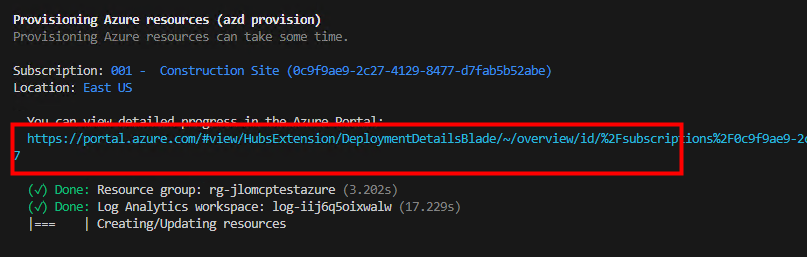

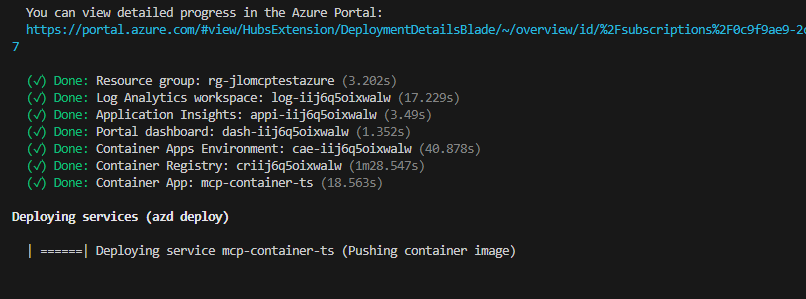

Attendez la fin du déploiement des ressources Azure :

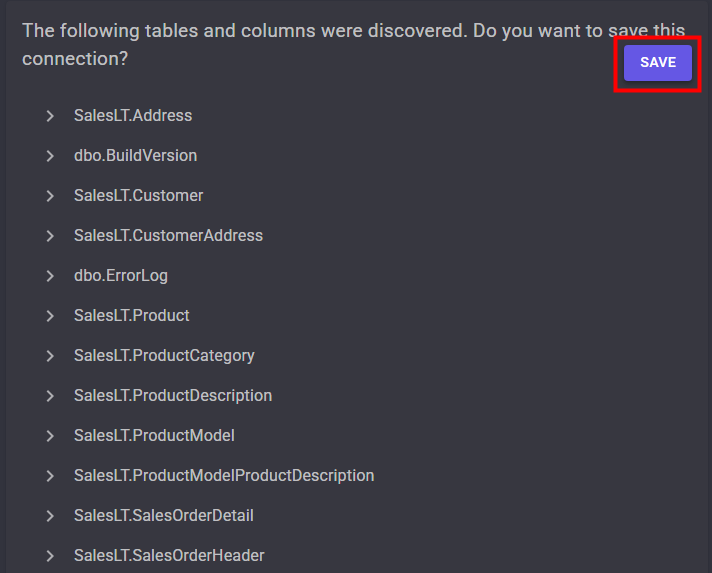

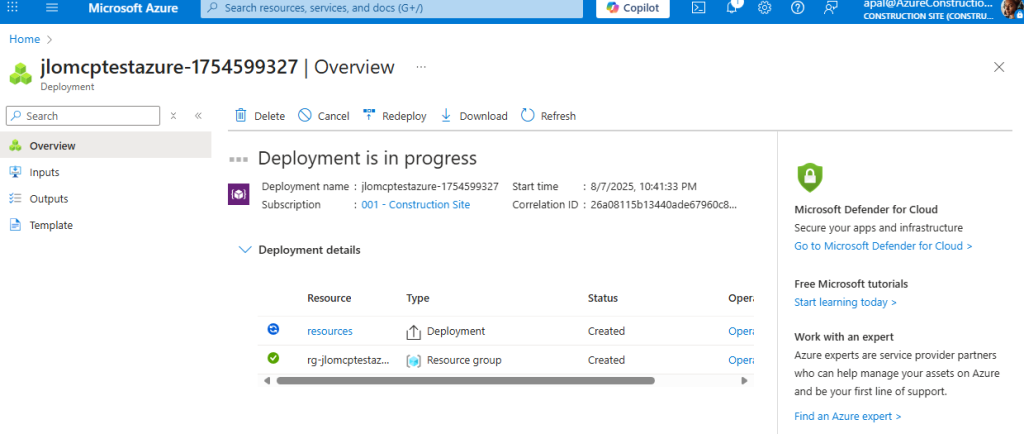

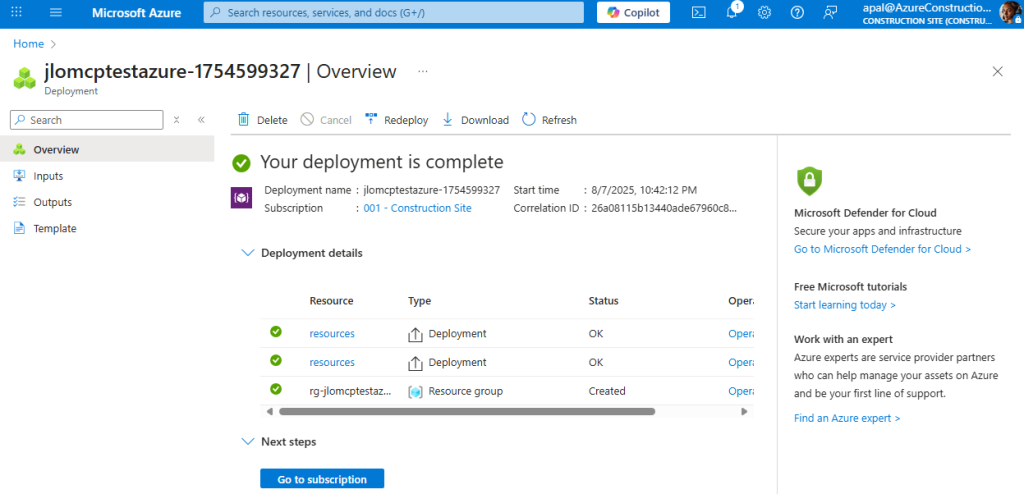

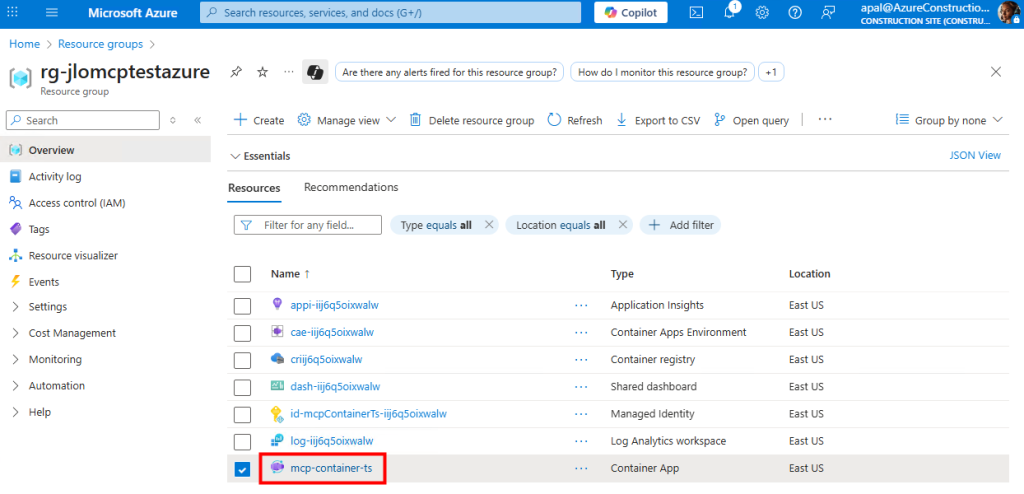

Sur le portail Azure, vérifiez la création complète des ressources :

Quelques minutes plus tard :

Attendez encore la fin du déploiement de l’image :

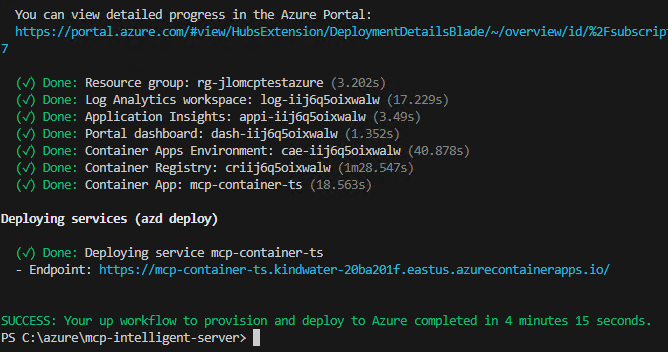

Constatez le déploiement terminé dans Visual Studio Code :

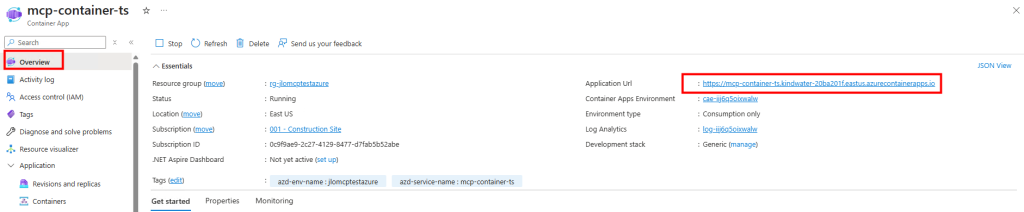

Retournez sur Azure et ouvrez la page de votre Azure Container App :

Copiez l’URL publique de votre application :

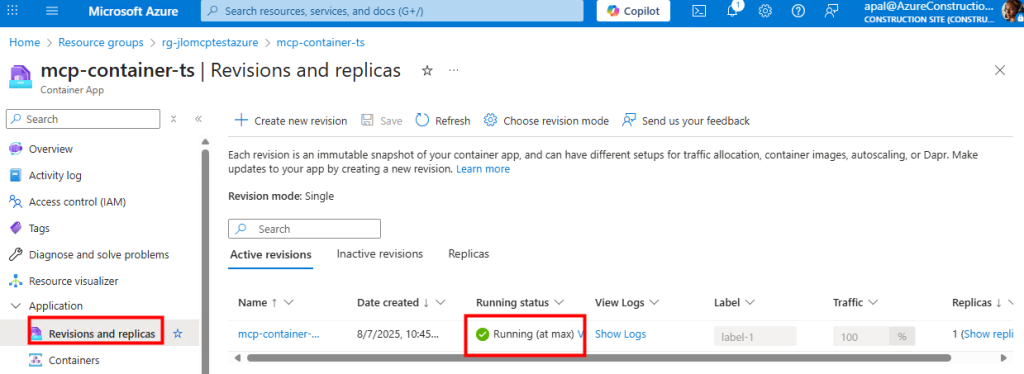

Dans la section Revisions and Replicas, vérifiez que le conteneur est démarré :

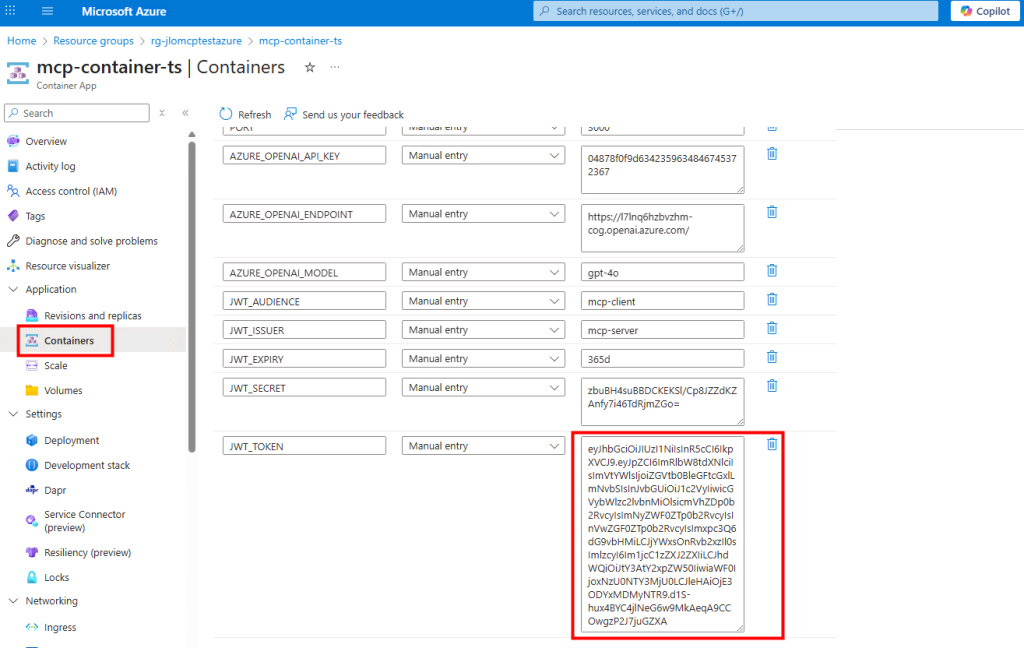

Dans Environment Variables, récupérez ou vérifiez la présence du token d’application :

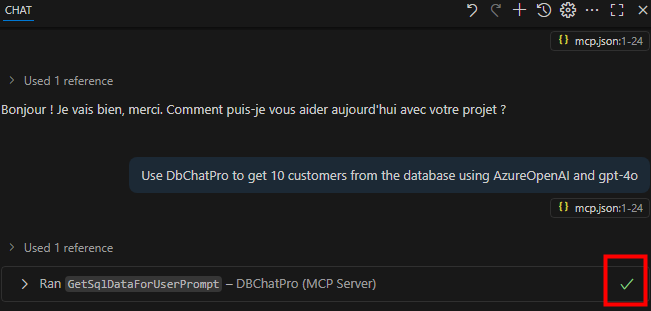

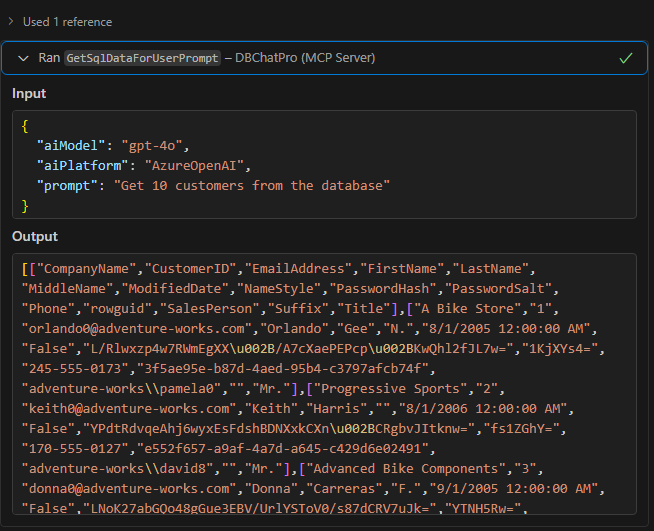

Depuis Visual Studio Code, relancez MCP Inspector en local :

npm run inspectCopiez l’URL avec le token de MCP Inspector :

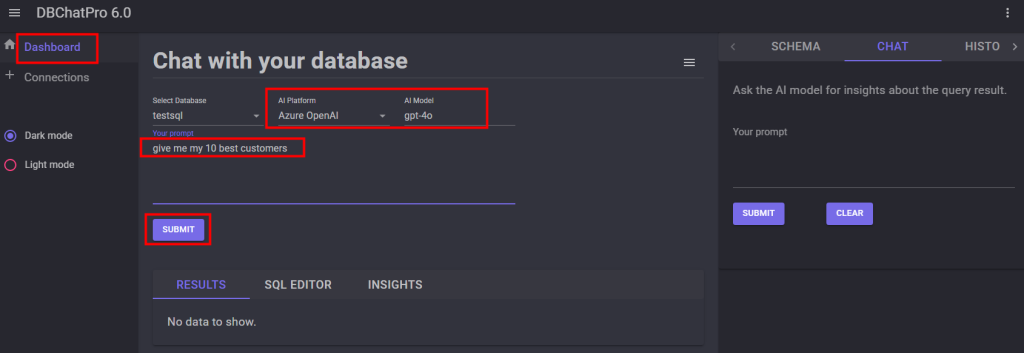

Connectez MCP Inspector à votre Azure Container App avec l’URL et le token :

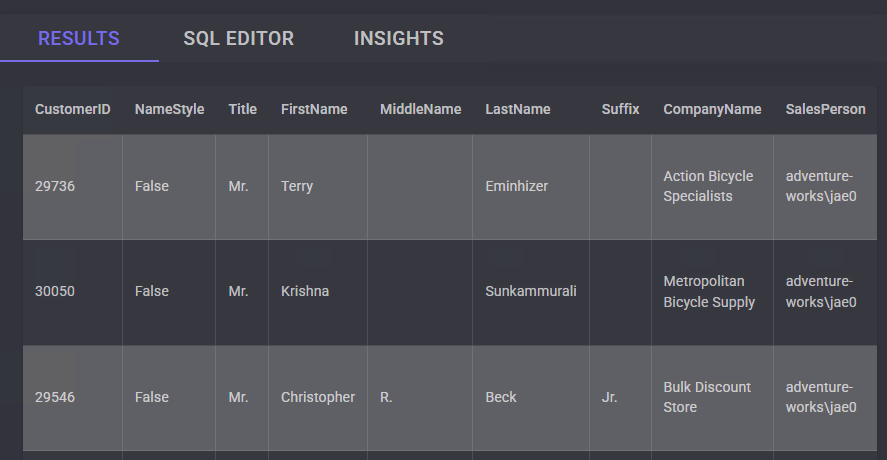

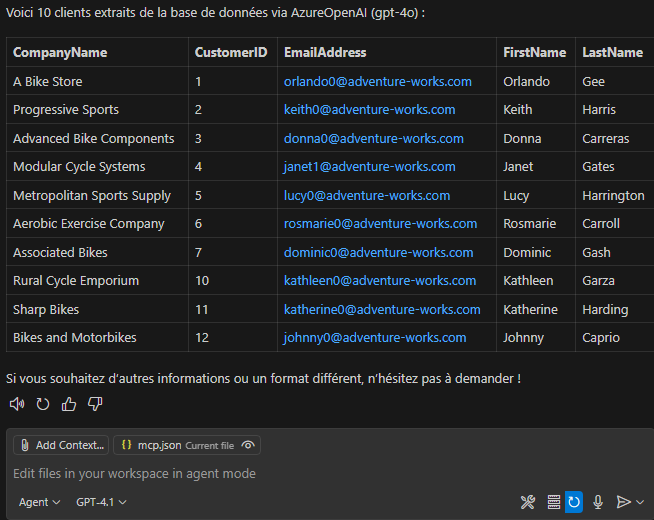

Effectuez à nouveau des opérations List_ToDo et créez de nouvelles tâches :

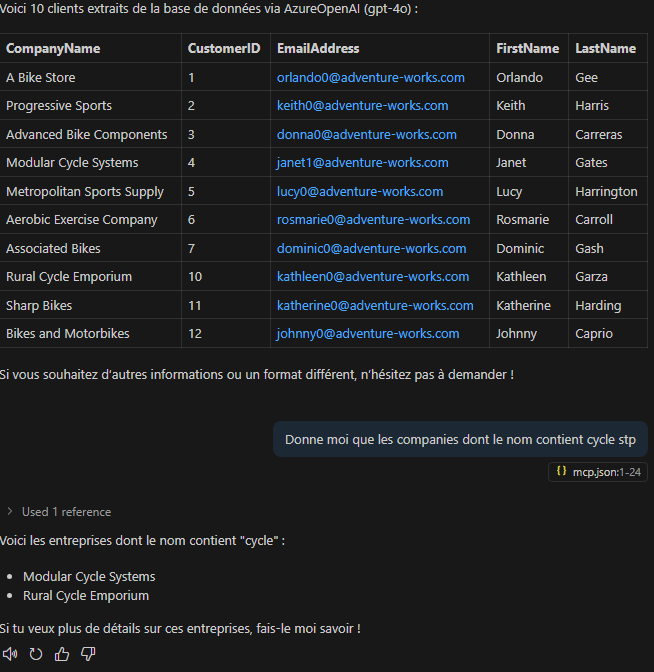

Testez différents prompts de listing et de complétion :

Testez également la partie prompting :

Vérifiez que la base temporaire SQLite est bien mise à jour :

Conclusion

Avec ce déploiement, vous disposez désormais d’un serveur MCP pleinement opérationnel, capable de dialoguer avec vos modèles d’IA et de gérer des outils de manière sécurisée, que ce soit en local ou dans le cloud Azure.

Et la suite ?

Si le sujet vous intéresse, je vous recommande vivement de consulter cette page, vous y trouverez d’autres serveurs MCP déjà mis à disposition, que vous pourrez tester pour découvrir leurs capacités, et dont la liste ne cesse de s’allonger.

Enfin, il peut également être intéressant d’explorer la création de serveurs MCP personnalisés dans l’environnement Microsoft 365, d’autant qu’une vidéo très pertinente sur le sujet est également disponible :